El espa?ol que creʫ una IA que aprende a falsificar discursos de la ONU en solo 13 horas

Dos investigadores de Global Pulse, una agencia de la ONU que trabaja con 'big data', han conseguido que un software genere discursos hiperrealistas sobre temas que van desde el desarme nuclear hasta los refugiados

El uso de la inteligencia artificial para generar y compartir informaciĘ«n falsa ya es un asunto preocupante para muchas instituciones. Uno de los ejemplos mĘós visuales son los deep fakes: vʬdeos falsos donde aparecen personajes pĘ▓blicos diciendo cosas que nunca han dicho. Es el caso de Barack Obama hablando, precisamente, de noticias falsas, o de Scarlett Johansson, que se encontrĘ« su cara en un vʬdeo porno protagonizado por otra persona. Los resultados son sorprendentemente realistas. Pero, mĘós allĘó de los vʬdeos, la inteligencia artificial tambiĘŽn se puede utilizar como generadora de textos falsos: puede crear discursos impecables, al nivel de los que grandes lʬderes mundiales pronuncian en la ONU, pero que nunca han sido pronunciados por nadie.

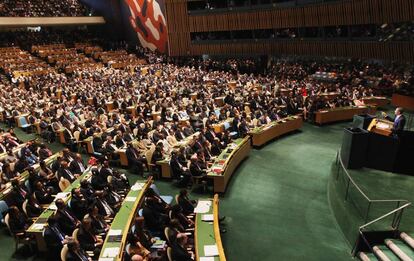

Utilizar la IA con este objetivo es cada vez mĘós sencillo. Para comprobar cĘ«mo de fĘócil es conseguirlo, dos investigadores de Global Pulse, una iniciativa de la ONU que trabaja con big data y su aplicaciĘ«n a la acciĘ«n humanitaria, han puesto a prueba a un software que ha sido entrenado con textos de Wikipedia y refinado con las transcripciones de texto de 7.507 discursos pronunciados por los representantes de los estados miembros en la Asamblea General de la ONU de 1970 a 2015.

Necesitaron solo datos y herramientas de cĘ«digo abierto y una inversiĘ«n de menos de diez euros (por el coste de los servidores). Trece horas despuĘŽs, el algoritmo era capaz de generar discursos sobre una amplia variedad de temas delicados y de gran importancia, desde el desarme nuclear hasta los refugiados. "El software produce un pĘórrafo sobre temas relevantes discutidos en la ONU en base a unas pocas palabras introducidas por una persona", explica Miguel Luengo-Oroz, chief data scientist de UN Global Pulse de la ONU y uno de los responsables del proyecto. "Este texto es generalmente coherente y, con una ediciĘ«n mʬnima, en algunos casos podrʬa ser indistinguible del escrito por un humano".

Los investigadores comprobaron que el discurso del modelo coincidʬa con el estilo y la cadencia de los discursos reales de la ONU en el 90% de los casos cuando los temas eran genĘŽricos, como el cambio climĘótico. Los resultados eran menos convincentes (coincidʬan en el 60% de los casos) cuando los temas eran mĘós concretos e incendiarios, como cuando se hablaba de inmigraciĘ«n o racismo.

Por quĘŽ es importante

El estudio demuestra la velocidad y la facilidad con la que es posible diseminar noticias falsas, generar discursos de odio y personificarlos en figuras de alto perfil. "Hemos realizado este experimento para llamar la atenciĘ«n sobre la disponibilidad de tecnologʬa de inteligencia artificial que puede ser usada para difundir fake news, suplantar personalidades o incluso escribir automĘóticamente un discurso inflamatorio y de odio en las redes", explica Luengo-Oroz. Este trabajo destaca la facilidad con que esto se puede lograr, asʬ como las amenazas de combinar estas tĘŽcnicas con otras tecnologʬas.

Los investigadores de Global Pulse concluyen que se necesita un mayor esfuerzo global para encontrar formas de detectar y responder al contenido generado por inteligencia artificial. "Es importante que como sociedad establezcamos barreras contra los deep fakes a varios niveles. El primer paso es educaciʫn y visibilidad para entender los riesgos", asegura Luengo-Oroz. Uno de los objetivos de su proyecto es precisamente resaltar los riesgos polʬticos y sociales potenciales que surgen del uso malicioso del software de generaciʫn de textos y su impacto potencial en los derechos humanos. "Es importante desarrollar soluciones sociales y tecnolʫgicas que puedan asegurar la veracidad de la informaciʫn".

Tu suscripciĘ«n se estĘó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciʫn?

Si continĘ▓as leyendo en este dispositivo, no se podrĘó leer en el otro.

FlechaTu suscripciĘ«n se estĘó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciĘ«n a la modalidad Premium, asʬ podrĘós a?adir otro usuario. Cada uno accederĘó con su propia cuenta de email, lo que os permitirĘó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripciĘ«n de empresa? Accede aquʬ para contratar mĘós cuentas.

En el caso de no saber quiĘŽn estĘó usando tu cuenta, te recomendamos cambiar tu contrase?a aquʬ.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarĘó en tu dispositivo y en el de la otra persona que estĘó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquʬ los tĘŽrminos y condiciones de la suscripciĘ«n digital.