Los ĄŪrobots asesinosĄŊ salen de la ciencia ficciĻŪn

La ONU convoca un encuentro internacional sobre el uso bĻĶlico de mĻĒquinas que pueden tomar la decisiĻŪn de matar

Los robots asesinos, mĻĒquinas que pueden tomar la decisiĻŪn de matar de forma independiente de cualquier control humano, han abandonado la ciencia ficciĻŪn para entrar de lleno en la agenda internacional sobre desarme: a partir del prĻŪximo lunes, la ONU reĻēne en Ginebra a decenas de expertos durante cinco dĻŠas para estudiar todas las implicaciones de los llamados Sistemas de Armas AutĻŪnomos Letales (LAWS, en sus siglas en inglĻĶs). El objetivo de los investigadores es convencer a la comunidad internacional para que impulse una prohibiciĻŪn global de este tipo de armas, que plantean profundos dilemas ĻĶticos, sobre todo en el terreno de las leyes de la guerra: ?quiĻĶn es responsable si una mĻĒquina autĻŪnoma comete un crimen? TodavĻŠa no existen; pero sĻŠ la tecnologĻŠa capaz de desarrollarlas.

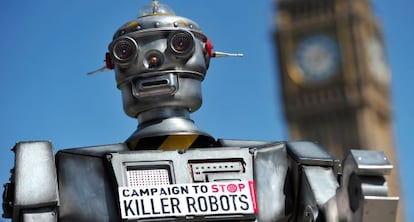

Ą°Soy muy optimista sobre la posibilidad de que se alcance un tratado para decretar su prohibiciĻŪnĄą, explica Noel Sharkey, profesor emĻĶrito de Inteligencia Artificial y RobĻŪtica en la Universidad de Sheffield y el acadĻĶmico que ha impulsado la mayor campa?a internacional contra los robots militares, Stop Killer Robots. Ą°Hay muchas naciones implicadas, aunque este tipo de decisiones requieren mucho tiempoĄą, agrega. Sharkey, que lleva casi una dĻĶcada dedicado exclusivamente a este problema, asegura que la reuniĻŪn de Ginebra se produce Ą°porque ha habido tanto debate sobre los robots asesinos, que las delegaciones nacionales en la ConvenciĻŪn sobre Armas Convencionales han decidido convocar a expertos para documentarse a fondo antes de tomar una decisiĻŪnĄą.

El objetivo de esta convenciĻŪn es el control de lo que se denominan Ą°armas inhumanasĄą y ha arrancado acuerdos internacionales para prohibir, por ejemplo, determinados tipos de minas antipersonales y los lĻĒser cegadores. Este armamento se prohibiĻŪ antes de que estuviese operativo y eso es lo que pretenden los cientĻŠficos: que los robots asesinos no lleguen a crearse nunca. Muchos paĻŠses han desarrollado sistemas de armas autĻŪnomos, como el x47-B de EE UU, un aviĻŪn que puede aterrizar y despegar solo. De hecho, la eficacia del escudo israelĻŠ CĻēpula de Hierro se basa en la robĻŪtica. Se han inventado armas que se mueven por su cuenta ĻCpor ejemplo, el Samsung SGR-1 surcoreano que patrulla la frontera con Corea del NorteĻC, pero la decisiĻŪn de abrir fuego sigue siendo humana. Por ahora.

Con motivo del encuentro de Ginebra, Human Rights Wacht y Harvard Law SchoolĄŊs International Human Rights Clinic han publicado este jueves un informe que relata lo que implicarĻŠa que las mĻĒquinas con capacidad para decidir sobre la vida y la muerte entrasen en el campo de batalla. Su conclusiĻŪn es clara: Ą°Recomendamos prohibir el desarrollo, la producciĻŪn y el uso de armas totalmente autĻŪnomas a travĻĶs de un instrumento legal internacionalĄą.

Una de las ideas contra las que lucha la campa?a internacional es que, en principio, no suena mal que sean mĻĒquinas, y no seres humanos, los que hagan las guerras. El panorama que describe este documento se parece bastante a Terminator: Ą°Desde una perspectiva moral, muchas personas encuentran terrible la idea de delegar en mĻĒquinas el poder de tomar decisiones sobre la vida o muerte en los conflictos armados. AdemĻĒs, aunque las armas completamente autĻŪnomas no se dejen llevar por el miedo o la ira, carecerĻŠan de compasiĻŪn, una salvaguarda clave para evitar la matanza de civiles.

Debido a que estas armas revolucionarĻŠan la guerra, tambiĻĶn pueden desatar una carrera armamentista. Una vez que estuviesen totalmente desarrolladas, se producirĻĒ una proliferaciĻŪn a estados irresponsables o grupos armados no estatales. Algunos crĻŠticos tambiĻĶn argumentan que el uso de robots podrĻŠa hacer mĻĒs fĻĒcil que los lĻŠderes polĻŠticos recurrirĻĒn a la fuerza porque reducirĻŠa el riesgo para sus propios soldadosĄą. A todo esto, habrĻŠa que sumar la responsabilidad ante las leyes de la guerra. Los expertos trazan el paralelismo con los coches autĻŪnomos, una tecnologĻŠa plenamente desarrollada, pero no circulan porque no se ha resuelto el problema de la responsabilidad si ocurre un accidente con un coche que conduce una mĻĒquina.

El ComitĻĶ Internacional para el Control de los Robots Armados (ICRAC), formado por cientĻŠficos, abogados, expertos en derechos humanos, ha desarrollado un argumentario para la reuniĻŪn de Ginebra con los problemas para la seguridad global que plantean las armas autĻŪnomas. Ą°Nos encontramos en un momento crĻŠtico en la evoluciĻŪn del armamento. TodavĻŠa estamos a tiempo para detener la automatizaciĻŪn de la decisiĻŪn de matar, para asegurarnos que todas las armas siguen estando controladas por seres humanosĄą, mantiene el texto.

Tu suscripciĻŪn se estĻĒ usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciĻŪn?

Si continĻēas leyendo en este dispositivo, no se podrĻĒ leer en el otro.

FlechaTu suscripciĻŪn se estĻĒ usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciĻŪn a la modalidad Premium, asĻŠ podrĻĒs a?adir otro usuario. Cada uno accederĻĒ con su propia cuenta de email, lo que os permitirĻĒ personalizar vuestra experiencia en EL PA?S.

En el caso de no saber quiĻĶn estĻĒ usando tu cuenta, te recomendamos cambiar tu contrase?a aquĻŠ.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarĻĒ en tu dispositivo y en el de la otra persona que estĻĒ usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquĻŠ los tĻĶrminos y condiciones de la suscripciĻŪn digital.

Sobre la firma