De cuando la filosof¿¬a rescat¿« a la inteligencia artificial

Tenemos que aprender a tratar a nuestros robots de forma ¿Ğtica, sostiene el autor. Muy posiblemente, nuestros robots ser¿ón m¿ós ¿Ğticos que nosotros ya que sabr¿ón tomar decisiones imparciales

A?o 2055. Detr¿ós de un veh¿¬culo aut¿«nomo (VA) circulan tres autobuses escolares. De repente, se cruza un borracho por la carretera. ?Qu¿Ğ debe hacer el veh¿¬culo? ?Frenar y salvar al peat¿«n, lo que provocar¿¬a un accidente en cadena, o atropellar al peat¿«n y evitar un accidente de peores consecuencias?

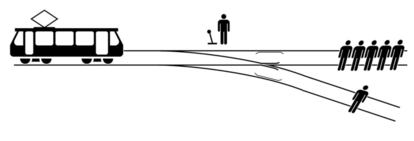

Esta es una versi¿«n del famoso Dilema del Tranv¿¬a planteado por la fil¿«sofa brit¿ónica Philippa Foot en 1967: un tren descontrolado va a arrollar a cinco personas. Accionando una palanca, un observador puede desviar el tren y, en ese caso, s¿«lo morir¿¬a una persona. ?Qu¿Ğ decisi¿«n es m¿ós ¿Ğtica? ?Permitir que el tren siga su curso sin interferir o sacrificar a una persona para salvar a cinco?

El 90% preferir¿¬a salvar a cinco personas y sacrificar a una, y adem¿ós seg¿▓n un reciente estudio de Natalie Gold (Universidad de Oxford), tambi¿Ğn hay importantes diferencias culturales entre oriente y occidente. Esta decisi¿«n mayoritaria se ajustar¿¬a a la teor¿¬a utilitarista del fil¿«sofo ingl¿Ğs Jeremy Bentham, que sosten¿¬a que la elecci¿«n moralmente correcta es aquella que maximiza el bien com¿▓n. Sin embargo, el utilitarismo tiene sus contradicciones porque, ?qu¿Ğ hubiese dicho ese 90% si la persona de la segunda v¿¬a fuera hijo suyo?

Michael Stevens, psic¿«logo estadounidense, hizo el experimento simulado del Dilema en 2017 y descubri¿« que la intenci¿«n ¿Ğtica y el instinto no tienen nada que ver. Seg¿▓n sus investigaciones, el 90% nunca accionar¿¬a la palanca, sino que se justificar¿¬a (í░seguro que el tren lleva sensoresí▒, í░alguien se dar¿ó cuentaí▒). Nadie quiere tener que elegir entre dos opciones horribles y luego responsabilizarse de las consecuencias, explica.

Entonces, si hay decisiones ¿Ğticas que ni siquiera nosotros podemos tomar, ?c¿«mo vamos a programar m¿óquinas inteligentes que s¿¬ lo hagan?

Para complicar las decisiones ¿Ğticas un poco m¿ós, debemos resaltar que el resultado de cualquier decisi¿«n depende de la variable tiempo, ya que no siempre las acciones tienen un resultado inmediato. Los investigadores Nidhi Kalra y David Groves de la RAND Corporation, calcularon que la libre introducci¿«n de VAs har¿¬a que sus algoritmos de conducci¿«n aprendieran m¿ós r¿ópidamente. Esto salvar¿¬a cientos de miles de vidas futuras. El beneficio de la acci¿«n, por lo tanto, ir¿¬a a parar a la siguiente generaci¿«n.

Cualquier aplicaci¿«n de IA presenta dilemas ¿Ğticos, no solo los veh¿¬culos aut¿«nomos. Por ejemplo, ?c¿«mo tratan los datos personales que recogen Siri (Apple) y Alexa (Amazon) en casa para aprender y mejorar la asistencia personalizada? Con el tiempo, Siri y Alexa se convertir¿ón en robots que ayudar¿ón en las tareas de la casa. Pero, ?qu¿Ğ conceptos ¿Ğticos les ense?aremos si en muchos casos ni siquiera sabemos tomar decisiones ¿Ğticas?

El bioqu¿¬mico y escritor Isaac Asimov escribi¿« las Tres Leyes de la Rob¿«tica?que vimos en la pel¿¬cula I, robot?para intentar apaciguar el miedo que nos generan las m¿óquinas. Los humanos desconfiamos incluso de las que funcionan mejor que nosotros mismos?y, por otra parte, les exigimos una perfecci¿«n que no tenemos. Un ejemplo: Waymo, el veh¿¬culo aut¿«nomo de Google, puede conducir sin fallo durante m¿ós de 8200 kil¿«metros pero, seg¿▓n un estudio del Pew Research Center, el 56% de los estadounidenses no se subir¿¬a jam¿ós a un veh¿¬culo de estas caracter¿¬sticas.

Las tres leyes son demasiado abstractas y carecen de contexto para una m¿óquina que s¿«lo entiende de unos y ceros, dice James Kuffner, catedr¿ótico de rob¿«tica en la Carnegie Mellon University. Y para el fil¿«sofo de IA Aaron Sloman, tampoco son capaces de resolver la cuesti¿«n del da?o a corto o largo plazo en relaci¿«n al beneficio.

Aparte de saber implementar conceptos ¿Ğticos, nuestro principal problema ser¿ó el aprender como humanos a tratar a nuestra IA de forma ¿Ğtica. Con relativa facilidad podemos dotar a las cosas de cualidades humanas y emocionales, como el actor Joaquin Phoenix a su novia virtual en la pel¿¬cula Her.?Nuestro antropomorfismo se acent¿▓a a¿▓n m¿ós si podemos tocar al robot y adem¿ós, ¿Ğste puede moverse. Muchos recordamos la historia del robot hitchBOT, creado por David Smith de McMaster University. hitchBOT apenas hablaba y su ¿▓nica misi¿«n era hacer auto-stop. Lleg¿« a Viajar por Europa y Norteam¿Ğrica gracias a la simpat¿¬a que generaba. Su asesinato en Philadelphia en 2015 tuvo una repercusi¿«n emocional en todo el planeta.?

Tenemos que aprender a tratar a nuestros robots de forma ¿Ğtica, pero no porque puedan rebelarse contra nosotros, sino porque el no hacerlo nos da?ar¿¬a psicol¿«gicamente, sostiene Kate Darling del Massachussetts Institute of Technology. Los robots son un reflejo de nuestra humanidad y su desarrollo nos est¿ó llevando a cuestionar muchos conceptos ¿Ğticos fundamentales que a¿▓n est¿ón por solucionar.

La aceptaci¿«n de la IA en la sociedad depender¿ó de hasta qu¿Ğ punto es segura, asimila nuestros c¿«digos de conducta y genera confianza. Y, muy posiblemente, nuestros robots ser¿ón m¿ós ¿Ğticos que nosotros ya que sabr¿ón tomar decisiones imparciales. Qui¿Ğn sabe si en el futuro los robots nos ense?ar¿ón a estar en el mundo de una forma m¿ós ¿Ğtica y justa.

Diego Miranda-Saavedra es cient¿¬fico de datos y profesor en los m¿óster de Inteligencia de Negocio y Big Data de los estudios de de Inform¿ótica, Multimedia y Comunicacion de la Universitat Oberta de Cataluya (UOC).

Tu suscripci¿«n se est¿ó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripci¿«n?

Si contin¿▓as leyendo en este dispositivo, no se podr¿ó leer en el otro.

FlechaTu suscripci¿«n se est¿ó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripci¿«n a la modalidad Premium, as¿¬ podr¿ós a?adir otro usuario. Cada uno acceder¿ó con su propia cuenta de email, lo que os permitir¿ó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripci¿«n de empresa? Accede aqu¿¬ para contratar m¿ós cuentas.

En el caso de no saber qui¿Ğn est¿ó usando tu cuenta, te recomendamos cambiar tu contrase?a aqu¿¬.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrar¿ó en tu dispositivo y en el de la otra persona que est¿ó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aqu¿¬ los t¿Ğrminos y condiciones de la suscripci¿«n digital.