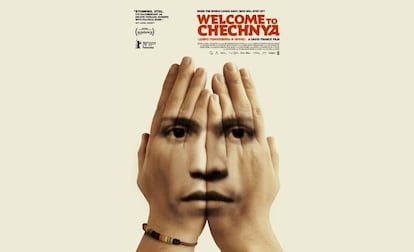

La otra cara del í«deepfakeí»: un intercambio de rostros para proteger a los mĘós vulnerables

El í«deep learningí» permite que las personas del colectivo LGBTQI que cuentan su historia en el documental Welcome to Chechnya lo hagan mirando a cĘómara, sin pixelados, pero con la cara de otra persona

En Chechenia, formar parte del colectivo LGBTQI puede convertirse en una sentencia de muerte, o con algo de suerte, servir de pase a una galerʬa de los horrores que incluye exorcismos religiosos, ingresos forzados en hospitales psiquiĘótricos, encarcelamientos y torturas. El propio presidente de la repĘ▓blica, Razam Kadyrov, ha expresado pĘ▓blicamente su apoyo a que sean sus propios familiares quienes la ejecuten. í░Si hubiera de estas personas en Chechenia, las fuerzas de seguridad no tendrʬan que hacer nada con ellos, porque sus familiares les enviarʬan a un lugar de no retornoí▒, ha llegado a afirmar su secretario de prensa.

Mostrar las atrocidades que ocurren en este contexto y en este siglo, y ante la general pasividad de la comunidad internacional, era el objetivo de David France en su Ę▓ltimo documental, Welcome to Chechnya. El director, conocido por sus trabajos en The Death and Life of Martha P. Johnson y History of a Plague, querʬa ademĘós dar voz a las vʬctimas sin aumentar su ya extrema vulnerabilidad. Los encargados de protegerles han sido uno de los desarrollos tecnolĘ«gicos mĘós demonizados del momento: los deepfakes.

France no querʬa grabar a los supervivientes en medio de la oscuridad o con caras pixeladas. Creʬa que esto podrʬa restarles humanidad. í░Lo que les propuse, y fueron suficientemente valientes para aceptar, fue que me dejaran grabarles sin restricciones, con la promesa de que despuĘŽs encontrarʬa alguna manera de ocultarlesí▒, explica en el dosier del documental. El encargado de hacer realidad este compromiso fue Ryan Lanney, fundador de la compa?ʬa de efectos especiales 300Ninjas.

Para proteger la identidad de los entrevistados en el documental, se desarrollaron deepfakes que reemplazaban sus rostros por los de activistas LGBTQ de Estados Unidos. El trabajo de Lanney redefine el discurso siniestro y alarmante que por ahora domina todo lo relacionado con los deepfakes, a los que propone rebautizar como tecnologʬas de reemplazo facial. í░Los deepfakes son inherentemente no consentidos. La persona que se introduce en el vʬdeo no tiene ni idea de lo ocurrido. En contraste, la gente que forma parte del documental tenʬa una estrecha relaciĘ«n con la compa?ʬa de producciĘ«ní▒.

Un escudo computacional

Como en cualquier proyecto de deep learning, la recopilaciĘ«n de datos fue fundamental. El punto de partida para 300Ninjas era las imĘógenes originales, ya cortadas y editadas. í░Revisamos la pelʬcula toma a toma, tomando en cuenta la iluminaciĘ«n, la luz exterior y la interiorí▒, precisa. DespuĘŽs, se rodaron las imĘógenes de los 24 activistas que donarʬan sus caras para proteger las de los supervivientes. í░Les sentamos en diferentes escenarios que cuadraban con la iluminaciĘ«n y los Ęóngulos del filmeí▒.

El resultado son las mismas declaraciones, expresando las mismas emociones desde otros rostros. í░Tuvimos mucho cuidado de hacer que no fuera perfectoí▒, matiza el experto. Esto se concreta en un leve difuminado en los bordes a cada una de las caras camufladas. í░Lo hicimos por dos motivos. Es nuestra manera de decir í«no estamos tratando de enga?arteí» y de que se entienda el peligro en que se encuentra esta genteí▒.

La misma magnitud de esos riesgos exigʬa garantizar que en ningĘ▓n caso estas imĘógenes permitieran identificar a los verdaderos narradores. En este contexto, los deepfakes se convierten en una mĘóscara excepcionalmente opaca, puesto que en las imĘógenes finales no queda ni rastro de los pʬxeles originales. í░No hay un filtro que puedas deshacerí▒. Con las voces tampoco hay nada que hacer, puesto que fueron reinterpretadas por actores de doblaje. í░Nos gustarʬa tener tambiĘŽn tecnologʬa para esto en el futuroí▒, comenta Lanney.

Cuando ponemos a alguien en penumbra para ocultar su identidad, o detrĘós de una pared o solo enfocamos sus manos, perdemos muchʬsima informaciĘ«n Ryan Lanney, 300Ninjas

El documental,que se ha estrenado ya en HBO en Estados Unidos, pasĘ« antes por Sundance y la Berlinale. Obtuvo buenas crʬticas en ambos festivales ĘC y despertĘ« con su uso de los deepfakes el interĘŽs de otros documentalistas. í░Este sistema permite contar una historia mucho mĘós humanaí▒, explica Lanney. í░Cuando ponemos a alguien en penumbra para ocultar su identidad, o detrĘós de una pared o solo enfocamos sus manos, perdemos muchʬsima informaciĘ«n. AdemĘós, pienso que es una representaciĘ«n mĘós honesta que recurrir a un actorí▒. El otro punto fuerte es la solidez con que el deepfake enmascara al hablante. í░Una persona que estĘó en peligro puede mostrarse mĘós dispuesta a dar su testimonio si estĘó segura de que su identidad estĘó a salvoí▒.

El experto ha dedicado hasta ahora su carrera a trabajar en el desarrollo de efectos especiales para ficciĘ«n -taquillazos incluidos-, pero tras su experiencia ideando las tecnologʬas necesarias para Welcome to Chechnya aspira a mantenerse en esta vertiente í░mĘós cʬvicaí▒. No duda que seguirĘón usĘóndose para fines negativos, pero tambiĘŽn estĘó seguro de que seguirĘón siendo una herramienta narrativa mĘós en la industria de los efectos especiales. í░Queremos tener un diĘólogo honesto con la audiencia y con las personas implicadas, por eso pienso que el tĘŽrmino fake no captura lo que hacemosí▒. Por lo que respecta al futuro y al potencial de las nuevas tĘŽcnicas, la opiniĘ«n de Lanney es que todo es posible. í░Hace cosa de diez a?os, un estudiante ense?Ę« a volar un pĘójaro hecho con grĘóficos computerizados. CreĘ« la estructura Ę«sea y las funciones aerodinĘómicas de las alas y le dijo que aprendiera a volar. Es difʬcil imaginar quĘŽ no serʬamos capaces de hacer solo con que alguien pase tiempo entrenando a una mĘóquinaí▒.

Tu suscripciĘ«n se estĘó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciʫn?

Si continĘ▓as leyendo en este dispositivo, no se podrĘó leer en el otro.

FlechaTu suscripciĘ«n se estĘó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciĘ«n a la modalidad Premium, asʬ podrĘós a?adir otro usuario. Cada uno accederĘó con su propia cuenta de email, lo que os permitirĘó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripciĘ«n de empresa? Accede aquʬ para contratar mĘós cuentas.

En el caso de no saber quiĘŽn estĘó usando tu cuenta, te recomendamos cambiar tu contrase?a aquʬ.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarĘó en tu dispositivo y en el de la otra persona que estĘó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquʬ los tĘŽrminos y condiciones de la suscripciĘ«n digital.