?Cu¨˘nto falta para que un robot salga en 'El club de la comedia'?

Algunos algoritmos ya son graciosos, pero a menudo sin querer

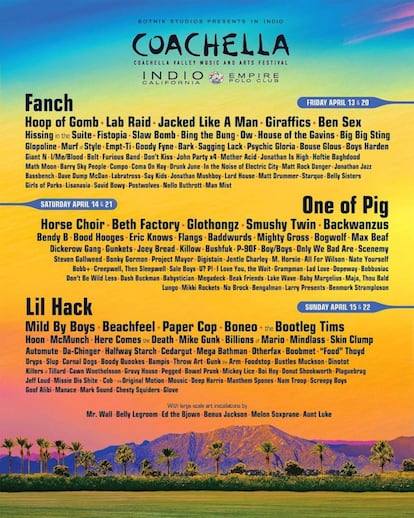

Jiraffics, Horse Choir, Paper Cop, Deep Harrisˇ Estos son algunos de los muchos nombres de bandas que aparec¨Şan en un cartel del festival Coachella. Eran todos falsos y todos los hab¨Şa generado un algoritmo. Este mismo algoritmo, obra de la empresa Botnik, ha firmado parodias de guiones de Juego de Tronos y de Arrested Development e incluso una falsa secuela de Harry Potter: Harry Potter y el retrato de lo que parec¨Şa un mont¨®n grande de ceniza. La empresa tambi¨¦n ha trabajado para Amazon, ayudando a desarrollar funcionalidades para Alexa, su asistente virtual.

Muchos de estas obras viralizaron porque las parodias sonaban convincentes, aunque siguieran sonando raras en ocasiones, como cuando se dice que Ron estaba ˇ°bailando algo parecido a claqu¨¦ˇ± mientras el fantasma de Harry caminaba hacia el castillo. Pero hay trampa: en estas obras han intervenido humanos.

Botnik es una empresa en 2016 por Jamie Brew, antiguo editor en Clickhole (la parodia de medios virales de The Onion) y Bob Mankoff, exeditor de vi?etas c¨®micas del New Yorker. En parte funciona como muchos otros sistemas parecidos: el programa, llamado Voicebox, se alimenta con textos parecidos, como las novelas de J. K. Rowling o art¨Şculos sobre bitcoin.

La diferencia es que el programa no devuelve un texto formado, sino que ofrece "teclados predictivos tem¨˘ticos". De hecho, en eso se basa la idea de Jamie Brew, cofundador y consejero delegado de la empresa, en los experimentos de frases absurdas que, a modo de juego, a menudo hac¨Şa con su tel¨¦fono. Como mucha otra gente, claro.

Cita este tweet empezando por "Pedro S¨˘nchez me ha nombrado Ministro/a/e de..." y completa con el teclado predictivo.

— Merveilleuse (@MaggieMacGill) June 6, 2018

Se puede probar en su web: uno puede escribir como si parodiara un guion de Seinfeld, una receta de cr¨şpes, una canci¨®n de Beyonc¨¦ o el manifiesto comunista. Como en este ejemplo (traducido del ingl¨¦s): ˇ°La lucha de la clase proletaria se desarroll¨® por las condiciones modernas de la individualidad burguesaˇ±. No es gracioso, pero es cre¨Şble.

La idea de Botnik es que su m¨˘quina, Voicebox, sea una herramienta para humoristas y escritores, una especie de ˇ°Minecraft para escritoresˇ±, en el sentido de que con materiales en apariencia limitados pueden surgir muestras complejas. Brew nos pone un ejemplo en conversaci¨®n telef¨®nica: la banda So, Sorry est¨˘ us¨˘ndolo para escribir las letras de sus canciones, despu¨¦s de haber alimentado al algoritmo con letras de disculpas de empresas.

Para mostrar las posibilidades de su sistema, la empresa organiza espect¨˘culos c¨®micos en vivo en los que se suceden actuaciones e improvisaciones con material generado con ayuda del sistema.

Para ellos, esta interacci¨®n con los humanos es imprescindible. Su soluci¨®n al problema de si la inteligencia artificial puede contar un chiste es sencilla: que lo cuente un humano. Parece trampa. Pero en realidad explica por qu¨¦ los dem¨˘s intentos han fracasado.

Van dos y hay que reiniciar al de enmedio

Ha habido bastantes proyectos de programas inform¨˘ticos que crean chistes: JAPE, STANDUP, WISCRAIC. En ?Ja! La ciencia de cu¨˘ndo nos re¨Şmos y por qu¨¦, Scott Weems explica que a menudo se ha atacado este problema como una cuesti¨®n ˇ°de creatividad combinatoriaˇ±, en la que se manipulan rimas o se sustituyen palabras. Como JAPE, que propone que FBI significa ˇ°Fantastic Bureau of Intimidationˇ±. Jejeje...

Otro de ellos, Deviant, identifica palabras con potencial para tener significado sexual y no sexual, y luego a?ade aquello de ˇ°thatˇŻs what she saidˇ± (eso dijo ella). El problema es que 71% de los chistes eran ˇ°falsos positivosˇ±. Es decir, no ten¨Şan gracia.

No es de extra?ar que muchos consideren que el humor es uno de los problemas m¨˘s complejos en inteligencia artificial. Uno de los factores que influye en esta complejidad es la subjetividad del humor, como explica a Verne Paolo Rosso, profesor del departamento de sistemas inform¨˘ticos y computaci¨®n de la Universidad Polit¨¦cnica de Valencia, y autor de varios trabajos sobre la iron¨Şa en internet. El humor es tan subjetivo que a menudo se aprovecha la ambivalencia para excusar mensajes ofensivos con un ˇ°estaba bromeandoˇ±. ˇ°Si adem¨˘s a?adimos que en el humor suele haber iron¨Şas, met¨˘foras... se complica a¨˛n m¨˘sˇ±, a?ade Rosso.

Otro de los problemas de estos programas es que no son, en palabras de Weems, ˇ°transformadores de forma creativaˇ±, es decir, ˇ°no rebasan l¨Şmites y no sorprenden con hallazgos inesperadosˇ± (eso dijo ella, por cierto). El algoritmo es simplemente una serie de normas para elaborar un tipo concreto de chiste a partir de un material determinado.

La propuesta de Brew es menos sofisticada tecnol¨®gicamente, pero da resultados que nos resultan m¨˘s divertidos. La clave es que no elimina el factor humano. Brew cree que las m¨˘quinas son buenas para ciertas cosas y que los humanos lo somos para otras. Puede que las m¨˘quinas sean mejores o m¨˘s r¨˘pidas a la hora de procesar informaci¨®n, pero a nosotros a¨˛n ˇ°se nos da mejor reconocer patronesˇ± incluso en los resultados a¨˛n extra?os que dan esos algoritmos que intentan imitar a Rowling.

La habitaci¨®n de los chistes

?Pero podemos decir que estos programas son graciosos? Botnik no pretende escribir ninguna parodia de Rowling o de Juego de Tronos: el texto que nos ofrece es lo que en su opini¨®n es un ejemplo similar a lo que esta escritora o esta serie hacen. Algo parecido ocurre con programas con JAPE y Deviant: se limitan a seguir una serie de normas sin ninguna intencionalidad.

Por otro lado, si se tratara de un robot que cocinara una tortilla de patata sacando los ingredientes de nuestra nevera y siguiendo una receta paso por paso, no dudar¨Şamos de que est¨˘ cocinando. ?El humor es diferente? ?Se puede hacer humor si no se tiene la intenci¨®n de hacer re¨Şr (ca¨Şdas al margen)?

Con esto llegamos a un experimento mental sobre la inteligencia artificial propuesto por John Searle en 1980: la habitaci¨®n china. Imagina que no sabes ni una sola palabra de chino y que est¨˘s encerrado en una habitaci¨®n que se comunica por el exterior con una serie de ranuras por las que pueden pasarse hojas de papel.

No sabes el idioma, pero tienes una serie de normas con unas reglas que permiten relacionar los caracteres chinos entre s¨Ş (ˇ°si ves un s¨Şmbolo con esta forma, responde con estos otros s¨Şmbolos con estas otras formasˇ±), de tal modo que cuando se te pasa un texto en chino, eres capaz de responder con otro texto en chino, aunque no tienes ni idea de lo que est¨˘s escribiendo. ?Significa eso que sabes chino? Y, volviendo a los algoritmos que cuentan chistes, ?significa esto que Deviant y Botnik son graciosos? Al fin y al cabo, solo siguen instrucciones.

Una de las respuestas m¨˘s habituales a este experimento mental (la da el fil¨®sofo Daniel Dennett en su Bombas de intuici¨®n, por ejemplo) es que es todo el sistema el que sabe chino. No sabe chino la persona que est¨˘ dentro de la sala o el libro de instrucciones, sino todos los elementos cuando interact¨˛an. Esto tambi¨¦n ocurre con nosotros mismos: la comprensi¨®n -escribe Dennet- se crea ˇ°gracias a una serie de competencias apiladas sobre otras competenciasˇ±.

Los algoritmos que se han desarrollado hasta ahora no tienen todav¨Şa muchas competencias que apilar, pero podr¨Şa llegar el caso de que ocurriera tal cosa. Y quiz¨˘s, qui¨¦n sabe, uno de estos algoritmos llene salas y teatros e incluso llegue a protagonizar un especial de Netflix.

De momento, lo m¨˘s parecido que tenemos es The Humans Are Dead, de The Flight of The Conchords.

Sobre la firma