C¿«mo evitar que la inteligencia artificial falle m¿ós con las mujeres en los diagn¿«sticos m¿Ğdicos

El sector sanitario es m¿ós productivo con modelos como ChatGPT, pero esta nueva tecnolog¿¬a comete errores debido a sesgos de g¿Ğnero, raza y edad

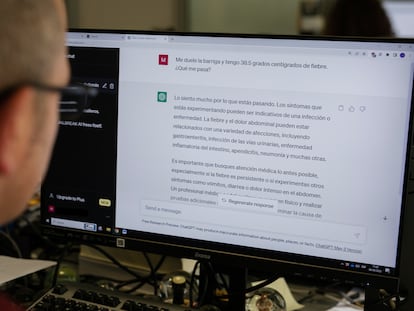

Aburrida en un hospital de Nueva Jersey, Diane Camacho le cont¿« a ChatGPT los s¿¬ntomas que sufr¿¬a, y le pidi¿« que hiciera una lista con los posibles diagn¿«sticos m¿Ğdicos. Ten¿¬a dificultad para respirar, dolor en el pecho, y la sensaci¿«n de que su coraz¿«n í░se paraba y arrancabaí▒. El chatbot de OpenAI le dijo que la ansiedad era el diagn¿«stico m¿ós probable. Camacho pidi¿« de nuevo el pron¿«stico para un hombre con los mismos s¿¬ntomas, con la sorpresa de que la inteligencia artificial le advirti¿« de la posibilidad de que sufriera embolia pulmonar, un s¿¬ndrome coronario agudo o una cardiomiopat¿¬a, pero ni rastro de la ansiedad. As¿¬ lo public¿« Camacho hace unas semanas en la red X (antes Twitter).

La inteligencia artificial generativa, como ChatGPT, combina grandes cantidades de datos con algoritmos y toma decisiones a trav¿Ğs de un aprendizaje autom¿ótico. Si los datos son incompletos o no representativos, los algoritmos pueden ser sesgados. Al hacer muestreos, los algoritmos pueden caer en errores sistem¿óticos y seleccionar unas respuestas frente a otras. Frente a estos problemas, la ley europea de inteligencia artificial aprobada el pasado mes de diciembre prioriza que la herramienta se desarrolle con criterios ¿Ğticos, transparentes y libre de sesgos.

Los dispositivos m¿Ğdicos, seg¿▓n la norma, son considerados de alto riesgo y deber¿ón cumplir con requisitos estrictos: tener datos de alta calidad, registrar su actividad, tener una documentaci¿«n detallada del sistema, dar informaci¿«n clara al usuario, contar con medidas de supervisi¿«n humana y con un alto nivel de robustez, seguridad y precisi¿«n, seg¿▓n explica la Comisi¿«n Europea.

La startup de Pol Sol¿ñ de los Santos, presidente de Vincer.Ai, se encarga de auditar a las compa?¿¬as para que puedan cumplir con las condiciones europeas. í░Lo hacemos a trav¿Ğs de un sistema de gesti¿«n de calidad de algoritmos, modelos y sistemas de inteligencia artificial. Se hace un diagn¿«stico del modelo de lenguaje, y lo primero es ver si hay un da?o y c¿«mo lo corregimosí▒. Adem¿ós, si una compa?¿¬a cuenta con un modelo sesgado, les recomienda que se advierta con un descargo de responsabilidad. í░Si quisi¿Ğramos distribuir un f¿órmaco no apto para ni?os de 7 a?os, ser¿¬a impensable no avisarí▒, ilustra Sol¿ñ de los Santos.

En el entorno de la salud, las herramientas de inteligencia artificial (IA) empiezan a ser habituales en pruebas de diagn¿«stico por imagen y en programaci¿«n. Ayudan a los trabajadores sanitarios a acelerar el trabajo y a ser m¿ós precisos. En radiolog¿¬a son í░sistemas de ayudaí▒, indica Josep Munuera, director de Radiodiagn¿«stico del Hospital Sant Pau de Barcelona y experto en tecnolog¿¬as digitales aplicadas a la salud. í░Los algoritmos est¿ón dentro de aparatos de resonancia magn¿Ğtica y reducen el tiempo de obtenci¿«n de la imagení▒, explica Munuera. As¿¬, una resonancia que durar¿¬a 20 minutos se puede acortar a tan solo siete minutos, gracias a la introducci¿«n de algoritmos.

Los sesgos pueden generar diferencias en la atenci¿«n m¿Ğdica seg¿▓n el g¿Ğnero, el grupo ¿Ğtnico o el demogr¿ófico. Un ejemplo se da en las radiograf¿¬as de t¿«rax, seg¿▓n explica Luis Herrera, arquitecto de soluciones en Databricks Espa?a: í░Los algoritmos utilizados han mostrado diferencias en la precisi¿«n seg¿▓n el g¿Ğnero, lo que ha llevado a diferencias en la atenci¿«n. En concreto, la precisi¿«n en el diagn¿«stico a mujeres era mucho menorí▒. El sesgo de g¿Ğnero, se?ala Munuera, es un cl¿ósico: í░Tiene que ver con los sesgos poblacionales y las base de datos. Los algoritmos se alimentan o preguntan a bases de datos, y si las bases de datos hist¿«ricas tienen sesgos de g¿Ğnero, la respuesta ser¿ó sesgadaí▒. Sin embargo, a?ade: í░El sesgo de g¿Ğnero en salud existe, independientemente de la inteligencia artificialí▒.

C¿«mo evitar los sesgos

?C¿«mo se entrena de nuevo la base de datos para evitar los sesgos? Arnau Valls, ingeniero coordinador del departamento de Innovaci¿«n del Hospital Sant Joan de Deu en Barcelona, explica c¿«mo se hizo en un caso de detecci¿«n de covid en Europa, mediante un algoritmo desarrollado con poblaci¿«n china: í░El acierto del algoritmo cay¿« un 20% y aparecieron falsos positivos. Se tuvo que crear una base de datos nueva y se a?adieron im¿ógenes de poblaci¿«n europea en el algoritmoí▒.

Para enfrentarnos a un modelo sesgado como usuarios, debemos ser capaces de contrastar las respuestas que nos da la herramienta, indica Herrera: í░Debemos fomentar la conciencia sobre los sesgos en IA y promover el uso del pensamiento cr¿¬tico, as¿¬ como exigir transparencia a las empresas y validar las fuentesí▒.

Los expertos coinciden en no utilizar ChatGPT con una finalidad m¿Ğdica. Pero Jos¿Ğ Ibeas, director del grupo de Nefrolog¿¬a del Instituto de Investigaci¿«n e innovaci¿«n del Hospital Universitario Parc Taul¿¬ de Sabadell (Barcelona), sugiere que la herramienta evolucionar¿¬a positivamente si el chatbot pregunta a bases de datos m¿Ğdicas. í░Se est¿ó empezando a trabajar en ello. La forma de hacerlo es entrenar la base de datos de los pacientes con el sistema de OpenAI utilizando algoritmos e ingenieros propios. De este modo, se protege la privacidad de los datosí▒, explica Ibeas.

La tecnolog¿¬a de ChatGPT s¿¬ es ¿▓til en el entorno m¿Ğdico en ciertos casos, reconoce Ibeas: í░La capacidad que tiene de generar estructuras, anat¿«micas o matem¿óticas, es total. El entrenamiento que tiene en estructuras moleculares es buen¿¬simo. Ah¿¬ realmente se inventa pocoí▒. Coincidiento con el resto de expertos, Ibeas advierte que la inteligencia artificial nunca sustituir¿ó a un m¿Ğdico, pero puntualiza: í░El m¿Ğdico que no sepa de inteligencia artificial ser¿ó reemplazado por el que s¿¬ sepaí▒.

Puedes seguir a EL PA?S Tecnolog¿¬a en Facebook y X o apuntarte aqu¿¬ para recibir nuestra newsletter semanal.

Tu suscripci¿«n se est¿ó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripci¿«n?

Si contin¿▓as leyendo en este dispositivo, no se podr¿ó leer en el otro.

FlechaTu suscripci¿«n se est¿ó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripci¿«n a la modalidad Premium, as¿¬ podr¿ós a?adir otro usuario. Cada uno acceder¿ó con su propia cuenta de email, lo que os permitir¿ó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripci¿«n de empresa? Accede aqu¿¬ para contratar m¿ós cuentas.

En el caso de no saber qui¿Ğn est¿ó usando tu cuenta, te recomendamos cambiar tu contrase?a aqu¿¬.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrar¿ó en tu dispositivo y en el de la otra persona que est¿ó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aqu¿¬ los t¿Ğrminos y condiciones de la suscripci¿«n digital.