í░Hay una gran presiĘ«n econĘ«mica para hacer obsoletos a los humanosí▒

En su libro 'Vida 3.0', el profesor del MIT propone argumentos para un debate global que evite que la llegada de la Inteligencia Artificial acabe en desastre

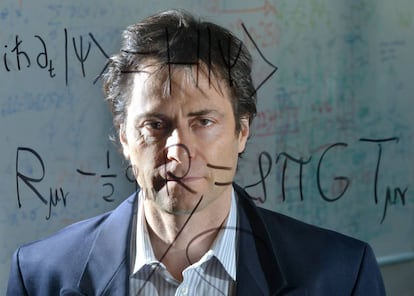

Cuando el rey Midas le pidiĘ« a Dionisio transformar en oro todo lo que tocase cometiĘ« un fallo de programaciĘ«n. No pensaba que el dios serʬa tan literal al concederle el deseo y solo fue consciente de su error cuando vio a su hija convertida en una estatua metĘólica. Max Tegmark (Estocolmo, 1967) cree que la inteligencia artificial puede presentar riesgos y oportunidades similares para la humanidad.

El profesor del MIT y director del Future of Life Institute en Cambridge (EE UU) estima que la llegada de una Inteligencia Artificial General (IAG) que supere a la humana es cuestiĘ«n de dĘŽcadas. En su visiĘ«n del futuro, podrʬamos acabar viviendo en una civilizaciĘ«n idʬlica donde robots superinteligentes harʬan nuestro trabajo, crearʬan curas para todas nuestras enfermedades o dise?asen sistemas para orde?ar la energʬa descomunal de los agujeros negros. Sin embargo, si no somos capaces de transmitirle nuestros objetivos con precisiĘ«n, tambiĘŽn es posible que a esa nueva inteligencia dominante no le interese nuestra supervivencia o, incluso, que asuma un objetivo absurdo como transformar en clips metĘólicos todos los Ęótomos del universo, los que conforman nuestros cuerpos incluidos.

Para evitar el apocalipsis, Tegmark considera que la comunidad global debe implicarse en un debate para orientar el desarrollo de la inteligencia artificial en nuestro beneficio. Esta discusiĘ«n deberĘó afrontar problemas concretos, como la gestiĘ«n de las desigualdades generadas por la automatizaciĘ«n del trabajo, pero tambiĘŽn un intenso esfuerzo filosĘ«fico que triunfe donde llevamos siglos fracasando y permita definir y acordar quĘŽ es bueno para toda la humanidad para despuĘŽs inculcĘórselo a las mĘóquinas.

Si se mira a las motivaciones de las compa?ʬas que estĘón desarrollando la IA, la principal es ganar dinero

Estos y otros temas relacionados con la discusiĘ«n que Tegmark considera mĘós importante para el futuro de la humanidad son los que recoge en su libro Vida 3.0: ser humano en la era de la inteligencia artificial, un ambicioso ensayo que han recomendado gurĘ▓s como Elon Musk en el que el cosmĘ«logo sueco trata de adelantarse a lo que puede suceder durante los prĘ«ximos milenios.

Pregunta. Los humanos, en particular durante los Ę▓ltimos dos o tres siglos, hemos tenido mucho ĘŽxito comprendiendo el mundo fʬsico, gracias al avance de disciplinas como la fʬsica o la quʬmica, pero no parece que hayamos sido tan eficaces entendiĘŽndonos a nosotros mismos, averiguando cĘ«mo ser felices o llegando a acuerdos sobre cĘ«mo hacer un mundo mejor para todo el mundo. ?CĘ«mo vamos a dirigir los objetivos de la IAG sin alcanzar antes acuerdos sobre estos asuntos?

Respuesta. Creo que nuestro futuro puede ser muy interesante si ganamos la carrera entre el poder creciente de la tecnologʬa y la sabidurʬa con la que se gestiona esa tecnologʬa. Para conseguirlo, tenemos que cambiar estrategias. Nuestra estrategia habitual consistʬa en aprender de nuestros errores. Inventamos el fuego, la fastidiamos unas cuantas veces y despuʎs inventamos el extintor; inventamos el coche, la volvimos a fastidiar varias veces e inventamos el cinturʫn de seguridad y el airbag. Pero con una tecnologʬa tan potente como las armas atʫmicas o la inteligencia artificial sobrehumana no vamos a poder aprender de nuestros errores. Tenemos que ser proactivos.

Es muy importante que no dejemos las discusiones sobre el futuro de la IA a un grupo de frikis de la tecnologʬa como yo sino que incluyamos a psicĘ«logos, sociĘ«logos o economistas para que participen en la conversaciĘ«n. Porque si el objetivo es la felicidad humana, tenemos que estudiar quĘŽ significa ser feliz. Si no hacemos eso, las decisiones sobre el futuro de la humanidad las tomarĘón unos cuantos frikis de la tecnologʬa, algunas compa?ʬas tecnolĘ«gicas o algunos Gobiernos, que no van a ser necesariamente los mejor cualificados para tomar estas decisiones para toda la humanidad.

P. ?La ideologʬa o la forma de ver el mundo de las personas que desarrollen la inteligencia artificial general definirĘó el comportamiento de esa inteligencia?

El Gobierno espa?ol ha rechazado unirse a otros paʬses en la ONU para prohibir las armas letales autʫnomas

R. Muchos de los lʬderes tecnolĘ«gicos que estĘón construyendo la IA son muy idealistas. Quieren que esto sea algo bueno para toda la humanidad. Pero si se mira a las motivaciones de las compa?ʬas que estĘón desarrollando la IA, la principal es ganar dinero. Siempre harĘós mĘós dinero si reemplazas humanos por mĘóquinas que puedan hacer los mismos productos mĘós baratos. No haces mĘós dinero dise?ando una IA que es mĘós bondadosa. Hay una gran presiĘ«n econĘ«mica para hacer que los humanos sean obsoletos.

La segunda gran motivaciĘ«n entre los cientʬficos es la curiosidad. Queremos ver cĘ«mo se puede hacer una inteligencia artificial por ver cĘ«mo funciona, a veces sin pensar demasiado en las consecuencias. Logramos construir armas atĘ«micas porque habʬa gente con curiosidad por saber cĘ«mo funcionaban los nĘ▓cleos atĘ«micos. Y despuĘŽs de inventarlo, muchos de aquellos cientʬficos desearon no haberlo hecho, pero ya era demasiado tarde, porque para entonces ya habʬa otros intereses controlando ese conocimiento.

P. En el libro parece que da por hecho que la IA facilitarĘó la eliminaciĘ«n de la pobreza y el sufrimiento. Con la tecnologʬa y las condiciones econĘ«micas actuales, ya tenemos la posibilidad de evitar una gran cantidad de sufrimiento, pero no lo hacemos porque no nos interesa lo suficiente o no le interesa a la gente con el poder necesario para conseguirlo. ?CĘ«mo podemos evitar que eso suceda cuando tengamos los beneficios de la inteligencia artificial?

R. En primer lugar, la tecnologʬa misma puede ser muy Ę▓til de muchas maneras. Cada a?o hay mucha gente que muere en accidentes de trĘófico que probablemente no morirʬan si fuesen en coches autĘ«nomos. Y hay mĘós gente en AmĘŽrica, diez veces mĘós, que mueren en accidentes hospitalarios. Muchos de esos se podrʬan salvar con IA si se utilizase para diagnosticar mejor o crear mejores medicinas. Todos los problemas que no hemos sido capaces de resolver debido a nuestra limitada inteligencia es algo que podrʬa resolver la IA. Pero eso no es suficiente. Como dice, ahora mismo tenemos muchos problemas que sabemos exactamente cĘ«mo resolver, como el hecho de que haya ni?os que vivan en paʬses ricos y no estĘŽn bien alimentados. No es un problema tecnolĘ«gico, es un problema de falta de voluntad polʬtica. Esto muestra lo importante de que la gente participe en esta discusiĘ«n y seleccionemos las prioridades correctas.

Por ejemplo, en Espa?a, el Gobierno espa?ol ha rechazado unirse a Austria y muchos otros paʬses en la ONU en un intento para prohibir las armas letales autĘ«nomas. Espa?a apoyĘ« la prohibiciĘ«n de armas biolĘ«gicas, algo que apoyaban los cientʬficos de esa Ęórea, pero no han hecho lo mismo para apoyar a los expertos en IA. Esto es algo que la gente puede hacer: Animar a sus polʬticos para que afronten estos asuntos y nos aseguremos de que dirigimos la tecnologʬa en la direcciĘ«n adecuada.

En los prĘ«ximos tres a?os comenzarĘó una nueva carrera armamentʬstica con armas letales autĘ«nomas

P. La conversaciĘ«n que propone en Vida 3.0 sobre la Inteligencia Artificial en el fondo es muy parecida a la que se deberʬa tener sobre polʬtica en general, sobre cĘ«mo convivimos entre nosotros o como compartimos los recursos. ?CĘ«mo crees que el cambio en la situaciĘ«n tecnolĘ«gica va a cambiar el debate pĘ▓blico?

R. Creo que va a hacer las cosas mĘós drĘósticas. Los cambios producidos por la ciencia se estĘón acelerando, todo tipo de trabajos desaparecerĘón cada vez mĘós rĘópido. Muchos se rʬen de la gente que votĘ« a Trump o a favor del Brexit, pero su rabia es muy real y los economistas te dirĘón que las razones por las que esta gente estĘó enfadada, por ser mĘós pobres de lo que eran sus padres, son reales. Y mientras no se haga nada para resolver estos problemas reales, su enfado aumentarĘó.

La Inteligencia Artificial puede crear una cantidad enorme de nueva riqueza, no se trata de un juego de suma cero. Si nos convencemos de que va a haber suficientes impuestos para proporcionar servicios sociales y unos ingresos bĘósicos, todo el mundo estarĘó feliz en lugar de enfadado. Hay gente a favor de la Renta BĘósica Universal, pero es posible que haya mejores formas de resolver el problema. Si los gobiernos van a dar dinero a la gente solo para apoyarles, tambiĘŽn se lo puede dar para que la gente trabaje como enfermeros o como profesoras, el tipo de trabajos que se sabe que dan un propĘ«sito a la vida de la gente, conexiones sociales...

No podemos volver a los criterios de distribuciĘ«n del Egipto de los faraones, en los que todo estaba en manos de un pu?ado de individuos, pero si una sola compa?ʬa puede desarrollar una inteligencia artificial general, es solo cuestiĘ«n de tiempo que esa compa?ʬa posea casi todo. Si la gente que acumule este poder no quiere compartirlo el futuro serĘó complicado.

P. Si no hacemos nada, ?cuĘól serʬan las principales amenazas provocadas por el desarrollo de la IA?

R. En los prĘ«ximos tres a?os comenzaremos una nueva carrera armamentʬstica con armas letales autĘ«nomas. Se producirĘón de forma masiva por los superpoderes y en poco tiempo organizaciones como ISIS podrĘón tenerlas. SerĘón los AK-47 del futuro salvo que en este caso son mĘóquinas perfectas para perpetrar asesinatos anĘ«nimos. En diez a?os, si no hacemos nada, vamos a ver mĘós desigualdad econĘ«mica. Y por Ę▓ltimo, hay mucha polĘŽmica sobre el tiempo necesario para crear una inteligencia artificial general, pero mĘós de la mitad de los investigadores en IA creen que sucederĘó en dĘŽcadas. En 40 a?os nos arriesgamos a perder completamente el control del planeta a manos de un peque?o grupo de gente que desarrolle la IA. Ese es el escenario catastrĘ«fico. Para evitarlo necesitamos que la gente se una a la conversaciĘ«n.

Tu suscripciĘ«n se estĘó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciʫn?

Si continĘ▓as leyendo en este dispositivo, no se podrĘó leer en el otro.

FlechaTu suscripciĘ«n se estĘó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciĘ«n a la modalidad Premium, asʬ podrĘós a?adir otro usuario. Cada uno accederĘó con su propia cuenta de email, lo que os permitirĘó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripciĘ«n de empresa? Accede aquʬ para contratar mĘós cuentas.

En el caso de no saber quiĘŽn estĘó usando tu cuenta, te recomendamos cambiar tu contrase?a aquʬ.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarĘó en tu dispositivo y en el de la otra persona que estĘó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquʬ los tĘŽrminos y condiciones de la suscripciĘ«n digital.

Sobre la firma