Judea Pearl: Ą°Los ordenadores pronto serĻĒn capaces de explicar el mundo y a ellos mismosĄą

El estadounidense, premio FundaciĻŪn BBVA Fronteras del Conocimiento, cree que en menos de 25 a?os la inteligencia artificial Ą°experimentarĻĒ una revoluciĻŪnĄą al entender el entorno

Nadie sabe quĻĶ razonamiento siguiĻŪ en 2016 AlphaGo, un programa desarrollado por DeepMind (Google), para derrotar sin paliativos al campeĻŪn del mundo de Go, un juego de origen chino considerado mucho mĻĒs complejo que el ajedrez. Ese sistema usĻŪ redes neuronales, que se apoyan en el deep learning o aprendizaje automĻĒtico. Se le ense?aron las reglas del juego, en el que el factor intuitivo es clave, y luego echĻŪ varias partidas contra sĻŠ mismo. Dicen los entendidos que AlphaGo desarrollĻŪ unas tĻĒcticas nunca antes vistas. Su victoria se interpretĻŪ como la prueba definitiva de que las mĻĒquinas ya no tienen rival. Aunque no seamos capaces de entender cĻŪmo llegĻŪ el programa a ese manejo.

Pero este modelo de desarrollo de la inteligencia artificial (IA), en el que la opacidad de los algoritmos es casi total, no es el Ļēnico en la disciplina. Frente a la propuesta del aprendizaje automĻĒtico hay otra tambiĻĶn muy potente, basada en sistemas de causalidad, que pretende arrojar luz sobre el proceso de toma de decisiones de la mĻĒquina. El padre de esta corriente es el estadounidense Judea Pearl, que la semana pasada fue distinguido con el premio FundaciĻŪn BBVA Fronteras del Conocimiento en la categorĻŠa de TecnologĻŠas de la InformaciĻŪn y la ComunicaciĻŪn. Un galardĻŪn mĻĒs para sus pobladas vitrinas, en las que luce desde 2011 el premio Turing (2011), considerado el Nobel de la informĻĒtica.

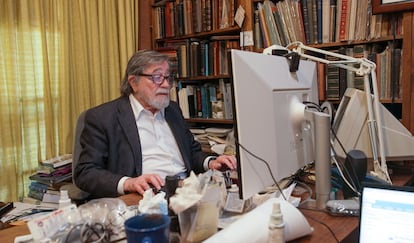

Pearl naciĻŪ en Tel Aviv en 1936, antes de la formaciĻŪn del Estado de Israel (entonces Mandato britĻĒnico de Palestina). En 1969 se incorporĻŪ a la Universidad de California en Los ?ngeles (UCLA), donde todavĻŠa ejerce como profesor a sus 85 a?os. Su gran contribuciĻŪn a la disciplina es la aplicaciĻŪn de las redes bayesianas para reducir la incertidumbre (lograr que la mĻĒquina no se vea abrumada ante la multiplicidad de variables que le impactan). De la mano de la estadĻŠstica, consiguiĻŪ desarrollar modelos de inteligencia artificial que traducĻŠan las variables en una especie de ĻĒrboles de decisiĻŪn en los que solo aparecĻŠan las opciones viables. Este sistema se iba perfeccionando, de manera que el programa no tenĻŠa que empezar a razonar de cero cada vez.

Los mĻĶtodos de Pearl se ense?an hoy en todas las facultades de InformĻĒtica y sus libros Ą°han inspirado avances trascendentales en la comprensiĻŪn del razonamiento y el pensamientoĄą, destacĻŪ el jurado del premio espa?ol. Su Ą°amplio y profundo impactoĄą se percibe en multitud de ĻĒreas y aplicaciones, como Ą°en el desarrollo de ensayos clĻŠnicos mĻĶdicos no sesgados y eficaces, en la psicologĻŠa, la robĻŪtica y la biologĻŠaĄą.

2022 serĻĒ un a?o agridulce para el cientĻŠfico estadounidense. Por un lado, ha conseguido uno de los galardones mejor remunerados del mundo; por otro, se cumplen 20 a?os del asesinato de su hijo, el periodista Daniel Pearl, que fue secuestrado, torturado y asesinado en PakistĻĒn por yihadistas. El trĻĒgico suceso no consiguiĻŪ interrumpir la carrera investigadora de Pearl. El cientĻŠfico atiende por telĻĶfono a EL PA?S desde su casa de Los ?ngeles.

Pregunta. ?En quĻĶ momento se encuentra el desarrollo de la inteligencia artificial?

Respuesta. Creo que en poco tiempo, dentro de entre cinco y 25 a?os, veremos una revoluciĻŪn. Los ordenadores pronto se comportarĻĒn de forma mĻĒs inteligente que hasta ahora, en parte gracias a los avances en la ciencia de la causa y el efecto. Los ordenadores serĻĒn capaces de explicar por quĻĶ tomaron sus decisiones, por quĻĶ es bueno que tĻē hagas una u otra cosa y quĻĶ va a pasar si no lo haces. Vamos hacia ordenadores capaces de explicar el mundo y a ellos mismos, y de volver hacia atrĻĒs y modificar su propio software. Y eso va a suceder en los prĻŪximos a?os. Supongo que ahora me querrĻĒ preguntar si esto es peligroso, si acabarĻĒ por desarrollarse una especie de organismo que controle el mundo. Me preocupa esa posibilidad, pero tambiĻĶn creo que deberĻŠamos ser capaces de controlar la situaciĻŪn.

P. ?Cree que la gente pone demasiadas esperanzas en el aprendizaje automĻĒtico?

R. El deep learning, no lo olvidemos, es una forma muy simple de IA. EstĻĒ en el primer escalĻŪn de complejidad, es fundamentalmente estadĻŠstica: solo es capaz de predecir cosas similares a las que ya ha visto anteriormente. Es cierto que se ha confiado en exceso en el deep learning debido a los grandes avances que ha impulsado en visiĻŪn computacional, reconocimiento de voz y vehĻŠculos autĻŪnomos, por ejemplo. Eso nos llevĻŪ a pensar que esta progresiĻŪn era imparable, que la inteligencia general estaba a la vuelta de la esquina. Ahora sabemos sus limitaciones. No podemos predecir los resultados de una intervenciĻŪn solo mirando pasivamente los datos. Tampoco se puede generar una explicaciĻŪn a partir de su contemplaciĻŪn.

P. ?CuĻĒl es entonces la principal limitaciĻŪn de la IA?

R. Cruzar la frontera entre la predicciĻŪn y la explicaciĻŪn de la acciĻŪn. Se trata de una diferencia que no se reconocĻŠa antes. Imagino que habrĻĒ otras grandes limitaciones; yo le puedo hablar de esta porque es con la que estoy familiarizado. Ahora sabemos cuĻĒl es el problema y creo que lo superaremos.

P. ?DeberĻŠa regularse el uso de algoritmos de IA que afecten a las vidas de las personas?

R. Creo que es prematuro legislar antes de entender quĻĶ significa protegernos de ello, quĻĶ se puede considerar un fracaso. Los abogados no deberĻŠan traducir sus miedos infundados en una legislaciĻŪn. Por supuesto que no queremos que la gente sea discriminada por su color de piel, origen nacional o estatus econĻŪmico. HabrĻĒ que entender quĻĶ significa esta correlaciĻŪn. Ahora tenemos los medios para clasificar los algoritmos en discriminatorios o justos. DeberĻŠa haber alguna regulaciĻŪn, pero no antes de entender quĻĶ es la justicia algorĻŠtmica. Y justicia es una nociĻŪn causal.

P. ?QuĻĶ quiere decir con eso?

R. La definiciĻŪn de justicia viene de un modelo causal. Porque ya fuera la raza o el sexo lo que aportĻŪ la apariencia de discriminaciĻŪn o inequidad, depende del modelo causal que tengas. PodrĻŠa ser una coincidencia estadĻŠstica, pero si hay intenciĻŪn de discriminar deben ser prohibidos. Algunos tipos de discriminaciĻŪn se relacionan causalmente con variables protegidas, y por tanto deberĻŠan ser regulados.

P. ?QuĻĶ le parece que las redes bayesianas que usted desarrollĻŪ sean ahora aprovechadas por empresas privadas para amasar grandes ingresos sin mostrar su cĻŪdigo?

R. No lo he visto todavĻŠa, pero sĻĶ que hay una tendencia a usarlas. Soy muy cauteloso con estas cosas. Por otra parte, si veo gente que desarrolla y usa adecuadamente el algoritmo que yo desarrollĻĶ, genial. No necesito que mi nombre estĻĶ en los crĻĶditos del producto. Me han dicho que hay una red bayesiana en cada iPhone, no lo sĻĶ. Google tampoco me dice cĻŪmo lo usan.

P. Si empezase ahora su carrera como investigador, ?por quĻĶ campo se interesarĻŠa?

R. Por la medicina personalizada. Y si me pusiera mĻĒs filosĻŪfico, por la inteligencia artificial social.

P. ?QuĻĶ es la inteligencia artificial social?

R. Consiste en conseguir que los ordenadores se comuniquen entre ellos igual que hacemos las personas. Con la idea de que cada uno de nosotros es un agente con voluntad propia, tiene creencias y deseos y que como especie social trabajamos juntos y formamos una sociedad en la que los unos confĻŠen en los otros. Hay que establecer relaciones extremadamente bĻĒsicas entre los ordenadores, que tengan los planos de otros ordenadores. Hay que buscar formar empatĻŠa, confianza, responsabilidad, arrepentimiento, mĻĶrito y acusaciĻŪn. Si conseguimos eso, los ordenadores trabajarĻĒn mucho mejor en sociedad que cada uno por su cuenta.

P. ?Eso podrĻŠa ayudarnos a entendernos mejor a nosotros mismos?

R. Exacto. Lo mĻĒs interesante de ese desarrollo serĻŠa llegar a comprender quĻĶ nos enfada, quĻĶ nos inspira confianza, por quĻĶ sentimos compasiĻŪn por otros. Los ordenadores serĻĒn un laboratorio para las ideas en ciencias sociales. Podremos implementar un planteamiento en algunas mĻĒquinas, apartarlas, cambiar algĻēn componente y ver quĻĶ pasa. CrearĻŠamos un avance tremendo en la comprensiĻŪn de nuestra vida social.

P. ?QuĻĶ consejo le darĻŠa a quien estĻĶ ahora mismo empezando su carrera de investigaciĻŪn en IA?

R. No aceptes el no como respuesta. No te metas en el aprendizaje profundo [por el deep learning], mĻĶtete en el entendimiento profundo. Evita el dogmatismo, recela de quienes insistan en una perspectiva y no atiendan la influencia de otros campos en el suyo. Algunas disciplinas son mĻĒs abiertas, otros mĻĒs cerradasĄ Elige una que muestre ser abierta, eso se puede ver entre otras cosas por el tipo de vocabulario tĻĶcnico que emplee.

Puedes seguir a EL PA?S TECNOLOG?A en Facebook y Twitter o apuntarte aquĻŠ para recibir nuestra newsletter semanal.

Tu suscripciĻŪn se estĻĒ usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciĻŪn?

Si continĻēas leyendo en este dispositivo, no se podrĻĒ leer en el otro.

FlechaTu suscripciĻŪn se estĻĒ usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciĻŪn a la modalidad Premium, asĻŠ podrĻĒs a?adir otro usuario. Cada uno accederĻĒ con su propia cuenta de email, lo que os permitirĻĒ personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripciĻŪn de empresa? Accede aquĻŠ para contratar mĻĒs cuentas.

En el caso de no saber quiĻĶn estĻĒ usando tu cuenta, te recomendamos cambiar tu contrase?a aquĻŠ.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarĻĒ en tu dispositivo y en el de la otra persona que estĻĒ usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquĻŠ los tĻĶrminos y condiciones de la suscripciĻŪn digital.

Sobre la firma