Leer la mente con mĻĒquinas para rescatar a los pacientes incomunicados

NeurocientĻŠficos e informĻĒticos estĻĒn desarrollando interfaces cerebro-computadora para que puedan comunicarse personas con sĻŠndrome de enclaustramiento y otras afecciones que impiden el habla

En la novela clĻĒsica de Alejandro Dumas, El conde de Montecristo, un personaje llamado Monsieur Noirtier de Villefort sufre un terrible infarto cerebral que lo deja paralĻŠtico. Aunque permanece despierto y consciente, ya no puede moverse ni hablar, y depende de su nieta Valentine para recitar el alfabeto y hojear un diccionario donde encontrar las letras y palabras que necesita. Con esta rudimentaria forma de comunicaciĻŪn, el decidido anciano consigue salvar a Valentine de ser envenenada por su madrastra y frustrar los intentos de su padre de casarla contra su voluntad.

El retrato que hace Dumas de este estado catastrĻŪfico (en el que, como ĻĶl dice, Ą°el alma estĻĒ atrapada en un cuerpo que ya no obedece sus ĻŪrdenesĄą) es una de las primeras descripciones del sĻŠndrome de enclaustramiento. Esta forma de parĻĒlisis profunda se produce cuando se da?a el tronco encefĻĒlico, generalmente a causa de un derrame cerebral, pero tambiĻĶn como resultado de tumores, lesiones cerebrales traumĻĒticas, mordeduras de serpiente, abuso de sustancias, infecciones o enfermedades neurodegenerativas como la esclerosis lateral amiotrĻŪfica (ELA).

Se cree que este trastorno es poco frecuente, aunque es difĻŠcil saber hasta quĻĶ punto. Muchos pacientes encerrados pueden comunicarse mediante movimientos oculares intencionados y parpadeos, pero otros pueden quedar completamente inmĻŪviles, perdiendo incluso la capacidad de mover los globos oculares o los pĻĒrpados; lo que imposibilita atender a la orden Ą°parpadea dos veces si me entiendesĄą. Como resultado, los pacientes pueden pasar una media de 79 dĻŠas encerrados en un cuerpo inmĻŪvil, conscientes pero incapaces de comunicarse, antes de que se les diagnostique adecuadamente.

La llegada de las interfaces cerebro-mĻĒquina ha alimentado la esperanza de devolver la comunicaciĻŪn a las personas en este estado de encierro, permitiĻĶndoles reconectar con el mundo exterior. Estas tecnologĻŠas suelen utilizar un dispositivo implantado para registrar las ondas cerebrales asociadas al habla y, a continuaciĻŪn, emplean algoritmos informĻĒticos para traducir los mensajes deseados. Los avances mĻĒs interesantes no requieren parpadeo, seguimiento ocular ni intentos de vocalizaciĻŪn, sino que capturan y transmiten las letras o palabras que una persona dice en silencio en su cabeza.

Ą°Creo que esta tecnologĻŠa tiene el potencial de ayudar a las personas que mĻĒs han perdido, a las que estĻĒn realmente enclaustradas y ya no pueden comunicarse en absolutoĄą, afirma Sarah Wandelt, estudiante de posgrado en computaciĻŪn y sistemas neuronales en Caltech de Pasadena (California, EE UU). Estudios recientes de Wandelt y otros han aportado las primeras pruebas de que las interfaces cerebro-mĻĒquina pueden descodificar el habla interna. Estos mĻĶtodos, aunque prometedores, suelen ser invasivos, laboriosos y caros, y los expertos coinciden en que necesitarĻĒn mucho mĻĒs desarrollo antes de poder dar voz a los pacientes enclaustrados.

El primer paso para crear una interfaz cerebro-mĻĒquina es decidir quĻĶ parte del cerebro se va a utilizar. Cuando Dumas era joven, muchos creĻŠan que los contornos del crĻĒneo servĻŠan de atlas para comprender el funcionamiento interno de la mente. TodavĻŠa se pueden encontrar vistosos diagramas frenolĻŪgicos (con secciones delimitadas para facultades humanas como la benevolencia, el apetito y el lenguaje) en anticuados textos mĻĶdicos y en las secciones de decoraciĻŪn de los grandes almacenes. Ą°Por supuesto, ahora sabemos que eso no tiene sentidoĄą, afirma David Bj?nes, neurocientĻŠfico e investigador postdoctoral en Caltech. De hecho, ahora estĻĒ claro que nuestras facultades y funciones surgen de una red de interacciones entre diversas ĻĒreas cerebrales, en la que cada ĻĒrea actĻēa como un nodo de la red neuronal. Esta complejidad supone un reto y una oportunidad: dado que aĻēn no se ha descubierto una regiĻŪn del cerebro responsable del lenguaje interno, varias regiones diferentes podrĻŠan ser objetivos viables.

Por ejemplo, Wandelt, Bj?nes y sus colegas descubrieron que una parte del lĻŪbulo parietal llamada circunvoluciĻŪn supramarginal (SMG), asociada normalmente a la acciĻŪn de agarrar objetos, tambiĻĶn se activa mucho durante el habla. Hicieron este sorprendente descubrimiento mientras observaban a un participante en un estudio tetraplĻĶjico al que habĻŠan implantado en el SMG una matriz de microelectrodos (dispositivo mĻĒs peque?o que la cabeza de un alfiler, cubierto de puntas metĻĒlicas en miniatura). La matriz puede registrar el disparo de neuronas individuales y transmitir los datos a travĻĶs de una mara?a de cables a una computadora para que los procese.

Involucrar al cerebro, pero ?cĻŪmo?

Bj?nes compara la configuraciĻŪn de su interfaz cerebro-mĻĒquina con un partido de fĻētbol americano. Imagine que su cerebro es el estadio de fĻētbol y que cada neurona es una persona en ese estadio. Los electrodos son los micrĻŪfonos que se bajan al estadio para poder escuchar. Ą°Esperamos colocarlos cerca del entrenador, o quizĻĒ de un locutor, o cerca de alguna persona del pĻēblico que sepa realmente lo que estĻĒ pasandoĄą, explica. Ą°Y entonces intentamos entender lo que ocurre en el campo. Cuando oĻŠmos el rugido del pĻēblico, ?es un touchdown? ?Fue una jugada de pase? ?Le han dado una patada al mariscal de campo? Intentamos entender las reglas del juego, y cuanta mĻĒs informaciĻŪn podamos obtener, mejor serĻĒ nuestro dispositivoĄą, a?ade el investigador.

En el cerebro, los dispositivos implantados se sitĻēan en el espacio extracelular entre neuronas, donde controlan las se?ales electroquĻŠmicas que se mueven a travĻĶs de las sinapsis, cada vez que se dispara una neurona. Si el implante capta las neuronas pertinentes, las se?ales que registran los electrodos parecen archivos de audio, reflejando un patrĻŪn diferente de picos y valles para distintas acciones o intenciones.

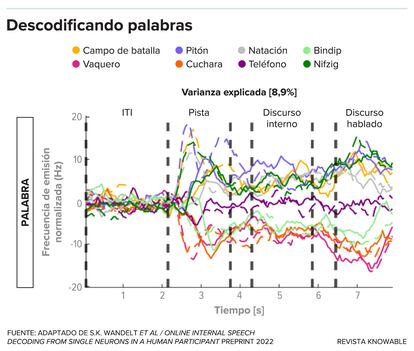

El equipo de Caltech entrenĻŪ su interfaz cerebro-mĻĒquina para reconocer los patrones cerebrales producidos cuando un participante tetraplĻĶjico en el estudio decĻŠa internamente seis palabras (campo de batalla, vaquero, pitĻŪn, cuchara, nataciĻŪn, telĻĶfono) y dos pseudopalabras (nifzig, bindip). Tras solo 15 minutos de entrenamiento, y utilizando un algoritmo de descodificaciĻŪn relativamente sencillo, el dispositivo pudo identificar las palabras con una precisiĻŪn superior al 90%.

Wandelt presentĻŪ el estudio, que aĻēn no se ha publicado en una revista cientĻŠfica revisada por pares, en el congreso de la Sociedad de Neurociencia de 2022, celebrado en San Diego (EE UU). En su opiniĻŪn, los resultados suponen una importante prueba de concepto, aunque habrĻŠa que ampliar el vocabulario antes de que un paciente enclaustrado pudiera frustrar a una madrastra malvada o conseguir un vaso de agua. Ą°Obviamente, las palabras que elegimos no eran las mĻĒs informativas; pero si se sustituyen por sĻŠ, no, por ciertas palabras que son realmente informativas, eso serĻŠa ĻētilĄą, dijo Wandelt en la reuniĻŪn.

Otro mĻĶtodo evita la necesidad de ampliar el vocabulario dise?ando una interfaz cerebro-mĻĒquina que reconoce letras en lugar de palabras. Intentando pronunciar en la boca las palabras que codifican cada letra del alfabeto romano, un paciente paralĻŠtico podrĻŠa deletrear cualquier palabra que se le pasara por la cabeza, encadenando esas palabras para comunicarse en frases completas.

Ą°Deletrear las cosas en voz alta con el habla es algo que hacemos muy a menudo, como cuando hablamos por telĻĶfono con un representante de atenciĻŪn al clienteĄą, dice Sean Metzger, estudiante de bioingenierĻŠa de la Universidad de California en San Francisco y la Universidad de California en Berkeley. Al igual que el ruido de la estĻĒtica en una lĻŠnea telefĻŪnica, las se?ales cerebrales pueden ser ruidosas. Utilizar palabras en clave de la OTAN (como Alfa para A, Bravo para B y Charlie para C) facilita discernir lo que alguien estĻĒ diciendo.

Pasar de pensamientos a letras

Metzger y sus colegas probaron esta idea en un participante incapaz de moverse o hablar como consecuencia de un ictus. Al participante en el estudio se le implantĻŪ una matriz mĻĒs grande de electrodos, del tama?o de una tarjeta de crĻĶdito, en una amplia franja de su corteza motora. En lugar de escuchar a escondidas neuronas individuales, este conjunto registra la actividad sincronizada de decenas de miles de neuronas, como si se oyera a toda una secciĻŪn de un estadio de fĻētbol rugiendo o animando al mismo tiempo.

Con esta tecnologĻŠa, los investigadores grabaron horas de datos y los introdujeron en sofisticados algoritmos de aprendizaje automĻĒtico. Fueron capaces de descifrar el 92% de las frases dichas en silencio por el sujeto del estudio (como Ą°EstĻĒ bienĄą o Ą°?QuĻĶ hora es?Ąą,) al menos en uno de cada dos intentos. El siguiente paso, segĻēn Metzger, podrĻŠa ser combinar este mĻĶtodo basado en la ortografĻŠa con otro basado en las palabras, que desarrollaron anteriormente, para que los usuarios pudieran comunicarse mĻĒs rĻĒpidamente y con menos esfuerzo.

En la actualidad, cerca de 40 personas de todo el mundo llevan implantadas matrices de microelectrodos, y cada vez hay mĻĒs. Muchos de estos voluntarios (personas paralizadas por accidentes cerebrovasculares, lesiones medulares o ELA) pasan horas conectados a computadoras, ayudando a los investigadores a desarrollar nuevas interfaces cerebro-mĻĒquina que permitan a otros, algĻēn dĻŠa, recuperar funciones que han perdido. Jun Wang, informĻĒtico y logopeda de la Universidad de Texas en Austin (EE UU), se muestra entusiasmado con los recientes avances en la creaciĻŪn de dispositivos para recuperar el habla, pero advierte de que aĻēn queda mucho camino por recorrer antes de su aplicaciĻŪn prĻĒctica. Ą°En este momento, todo este campo estĻĒ aĻēn en una fase inicialĄą.

A Wang y otros expertos les gustarĻŠa ver mejoras en el hardware y el software que hicieran los dispositivos menos engorrosos, mĻĒs precisos y mĻĒs rĻĒpidos. Por ejemplo, el dispositivo pionero del laboratorio de la Universidad de California en San Francisco funcionaba a un ritmo de unas siete palabras por minuto, mientras que el habla natural va a unas 150 palabras por minuto. E incluso si la tecnologĻŠa evoluciona hasta imitar el habla humana, no estĻĒ claro si los enfoques desarrollados en pacientes con cierta capacidad para moverse o hablar funcionarĻĒn en los que estĻĒn completamente enclaustrados. Ą°Mi intuiciĻŪn es que funcionarĻŠa, pero no puedo asegurarloĄą, dice Metzger, Ą°tendrĻŠamos que verificarloĄą.

Otra pregunta que permanece sin respuesta es si es posible dise?ar interfaces cerebro-mĻĒquina que no requieran cirugĻŠa cerebral. Los intentos de crear enfoques no invasivos han fracasado porque tales dispositivos han tratado de dar sentido a se?ales que han viajado a travĻĶs de capas de tejido y hueso, como si se tratara de seguir un partido de fĻētbol desde el aparcamiento.

Wang ha progresado utilizando una tĻĶcnica de imagen avanzada, llamada magnetoencefalografĻŠa (MEG), que registra en el exterior del crĻĒneo los campos magnĻĶticos generados por las corrientes elĻĶctricas en el cerebro, y luego traduce esas se?ales en texto. Ahora intenta construir un aparato que reconozca los 44 fonemas de la lengua inglesa (como ph u oo) para construir sĻŠlabas, palabras y frases.

En Ļēltima instancia, el mayor reto para restablecer el habla en pacientes encerrados puede tener mĻĒs que ver con la biologĻŠa que con la tecnologĻŠa. La forma en que se codifica el habla, sobre todo el habla interna, puede variar segĻēn el individuo o la situaciĻŪn. Una persona puede imaginarse garabateando una palabra en una hoja de papel y visualizarlo mentalmente; otra puede oĻŠr la palabra, aun sin que sea pronunciada, resonando en sus oĻŠdos; otra puede asociar una palabra con su significado, evocando un estado de ĻĒnimo concreto. Dado que cada persona puede asociar distintas ondas cerebrales a distintas palabras, habrĻĒ que adaptar las tĻĶcnicas a la naturaleza individual de cada persona. Ą°Creo que este enfoque mĻēltiple de los distintos grupos es nuestra mejor manera de cubrir todas nuestras bases, y asĻŠ tener planteamientos que funcionen en un montĻŪn de contextos distintosĄą, dice Bj?nes.

ArtĻŠculo traducido por Debbie Ponchner.

Este artĻŠculo apareciĻŪ originalmente en Knowable en espa?ol, una publicaciĻŪn sin ĻĒnimo de lucro dedicada a poner el conocimiento cientĻŠfico al alcance de todos.

Puedes seguir a EL PA?S TecnologĻŠa en Facebook y Twitter o apuntarte aquĻŠ para recibir nuestra newsletter semanal.

Tu suscripciĻŪn se estĻĒ usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciĻŪn?

Si continĻēas leyendo en este dispositivo, no se podrĻĒ leer en el otro.

FlechaTu suscripciĻŪn se estĻĒ usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciĻŪn a la modalidad Premium, asĻŠ podrĻĒs a?adir otro usuario. Cada uno accederĻĒ con su propia cuenta de email, lo que os permitirĻĒ personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripciĻŪn de empresa? Accede aquĻŠ para contratar mĻĒs cuentas.

En el caso de no saber quiĻĶn estĻĒ usando tu cuenta, te recomendamos cambiar tu contrase?a aquĻŠ.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarĻĒ en tu dispositivo y en el de la otra persona que estĻĒ usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquĻŠ los tĻĶrminos y condiciones de la suscripciĻŪn digital.