La regulaci¿«n de la inteligencia artificial se acelera despu¿Ğs de que controle ya todos los ¿ómbitos

Un total de 28 pa¿¬ses y la Uni¿«n Europea urgen la implantaci¿«n de normas que eviten entre el 20% y el 30% de los efectos negativos que se esperan de los nuevos sistemas

La inteligencia artificial (IA) se ha metido en nuestras vidas de forma vertiginosa (hace menos de un a?o de la irrupci¿«n de ChatGPT) y dirige ya, sin que nos demos cuenta, casi todas las actividades cotidianas, desde las pel¿¬culas que vemos hasta nuestro trabajo, compras o relaciones. Un estudio sobre su uso en objetivos de sostenibilidad, publicado en Nature, detect¿« que entre el 70% y el 80% de los usos tienen consecuencias positivas, pero el resto de los efectos pueden ser negativos. Estos porcentajes son extrapolables a otras ¿óreas y son cruciales porque afectan a las vidas, a la salud, a la convivencia, a la democracia o a la capacidad de desarrollo. Hasta ahora solo hab¿¬a principios ¿Ğticos insuficientes. El presidente de EE UU, Joe Biden, acaba de firmar un decreto que obliga a las tecnol¿«gicas a notificar al Gobierno cualquier avance que suponga un í░riesgo grave para la seguridad nacionalí▒. El primer ministro brit¿ónico, Rishi Sunak, ha convocado este mi¿Ğrcoles y jueves una cumbre de la que ha surgido el primer compromiso de 28 pa¿¬ses y de la UE sobre estos sistemas (Declaraci¿«n de Bletchley) y la creaci¿«n de un grupo de expertos para el seguimiento de sus avances. La Uni¿«n Europea ultima su propia norma: la AI Act. La vicepresidenta primera del Gobierno en funciones y ministra de Asuntos Econ¿«micos y Transformaci¿«n Digital, Nadia Calvi?o, estima que se aprobar¿ó en las pr¿«ximas semanas.

La Declaraci¿«n de Bletchley reconoce la encrucijada actual: í░La inteligencia artificial presenta enormes oportunidades globales: tiene el potencial de transformar y mejorar el bienestar humano, la paz y la prosperidad. Para lograr esto, afirmamos que, por el bien de todas las personas, la IA debe dise?arse, desarrollarse, implementarse y utilizarse de manera segura, centrada en el ser humano, confiable y responsableí▒.

La inteligencia artificial son sistemas y programas capaces de replicar tareas propias de su hom¿«loga humana, como el aprendizaje, el razonamiento o la toma de decisiones. Se fundamenta en datos, el alimento b¿ósico, y en algoritmos, el conjunto met¿«dico de pasos para hacer c¿ólculos, resolver problemas y decidir a partir de la informaci¿«n disponible. Y puede llegar a hacerlo sin la intervenci¿«n humana: el aprendizaje autom¿ótico permite que las m¿óquinas se instruyan a partir de sus propios procesos o de otros dispositivos.

Naci¿« oficialmente como disciplina en una conferencia de ciencias de la computaci¿«n en el Dartmouth College (New Hampshire, EE UU), en 1956. Sus padres fueron John McCarthy, de la Universidad de Stanford; Allen Newell, Herbert Simon, ambos de Carnegie Mellon; y Marvin Minsky, del Instituto Tecnol¿«gico de Massachusetts (MIT) y premio Fronteras del Conocimiento de la Fundaci¿«n BBVA en 2014. Todos part¿¬an de la premisa de que las m¿óquinas pueden imitar al cerebro. Pero tras d¿Ğcadas de un uso restringido, en los ¿▓ltimos a?os, su utilizaci¿«n se ha generalizado y extendido a todas las actividades, llegando a ser accesible mediante simples comandos de voz. Y aqu¿¬ surgen su enorme potencial y los conflictos. í░La IA debe ser la soluci¿«n, pero no el problemaí▒, defiende Coral Calero, catedr¿ótica de Lenguajes y Sistemas Inform¿óticos de la Universidad de Castilla-La Mancha (UCLM) e integrante del Comit¿Ğ Espa?ol de ?tica de la Investigaci¿«n creado por el Ministerio de Ciencia e Innovaci¿«n.

La Inteligencia artificial es capaz de identificar las alteraciones en el genoma que provocan la aparici¿«n de enfermedades o reducir a d¿¬as el hallazgo de mol¿Ğculas con propiedades medicinales u optimizar procesos industriales y crear puestos de trabajo o diagnosticar a trav¿Ğs de im¿ógenes o generar textos, v¿¬deos y sonidos o recrear un personaje o elegir pel¿¬culas y productos a partir de los gustos del usuario o seleccionar inversiones. La lista es inabarcable.

Pero esa misma tecnolog¿¬a es uno de los vectores emergentes de fraude m¿ós preocupantes (secuestro de datos) y puede utilizarse para generar bulos, desprestigiar a una persona, manipular precios, alterar el mercado laboral (dejando empleos y trabajadores obsoletos), atacar a competidores, influir en la opini¿«n p¿▓blica en elecciones, fortalecer el alcance de una campa?a de desinformaci¿«n, crear y diseminar propaganda, especialmente en tiempos de guerra, o como arma machista. Un ejemplo de esto ¿▓ltimo ha sido la detenci¿«n en Almendralejo, a finales de septiembre, de una veintena de menores por recrear con inteligencia artificial desnudos de compa?eras de instituto.

Ricardo Vinuesa, profesor asociado en el KTH Real Instituto de Tecnolog¿¬a de Estocolmo e investigador de IA, ha sido uno de los primeros en evaluar los efectos de esta tecnolog¿¬a a partir de su uso para alcanzar metas de sostenibilidad. í░El 70% de los objetivos pueden verse afectados positivamente por la IA, pero alrededor del 30% pueden verse afectados negativamente. Tenemos muchos desaf¿¬osí▒, afirma en un encuentro celebrado en la Universidad de Sevilla.

En este sentido, Miguel Escassi, responsable de Pol¿¬tica P¿▓blica en Google para Espa?a y Portugal advierte: í░Tenemos una oportunidad ¿▓nica para acelerar el crecimiento econ¿«mico y avanzar en todos los retos sociales que tenemos por delante. La capacidad de desplegar la inteligencia artificial e innovar con ella a gran escala definir¿ó la competitividad en la pr¿«xima d¿Ğcada. Sin embargo, para no dejar pasar estas oportunidades, los responsables pol¿¬ticos deben encontrar el equilibrio virtuoso entre maximizar las ventajas de la inteligencia artificial y minimizar sus riesgos, que tambi¿Ğn existení▒.

Necesitamos regular la IA porque es demasiado importante para no hacerlo. Y no solo es necesaria la norma, sino hacerla bienPilar Manch¿«n, consejera del comit¿Ğ de asesoramiento del Gobierno espa?ol y responsable de estrategia de investigaci¿«n de Google

Pilar Manch¿«n, consejera del comit¿Ğ de asesoramiento del Gobierno espa?ol y responsable de estrategia de investigaci¿«n con inteligencia artificial tambi¿Ğn en Google, califica esta era marcada por la herramienta inform¿ótica como í░el nuevo renacimientoí▒, pero tambi¿Ğn reclama un marco de actuaci¿«n: í░Necesitamos regularla porque la IA es demasiado importante para no hacerlo. Y no solo es necesaria la norma, sino hacerla biení▒.

í░Tenemos que reducir las incertidumbres de la IA y esforzarnos en desarrollar herramientas que mejoren la calidad de los datos para estar seguros de que no se excluye ning¿▓n aspectoí▒, a?ade Matteo Rucco, cient¿¬fico de Rexasi-Pro, un proyecto europeo para desarrollar soluciones de inteligencia artificial confiables y no discriminatorias.

Si piensas en c¿«mo trabaja la mente, cuando tomamos una decisi¿«n tambi¿Ğn imaginamos las consecuencias y eso debe ser parte de la inteligencia artificialMichael Beetz, investigador del Instituto de Inteligencia Artificial de la Universidad de Bremen

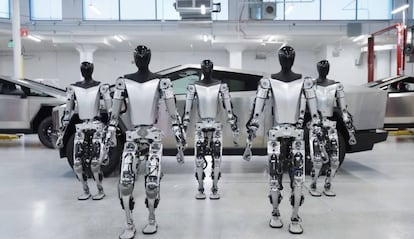

Michael Beetz, investigador del Instituto de Inteligencia Artificial de la Universidad de Bremen, se fija no solo en los prejuicios que el programador puede inferir a los algoritmos, sino tambi¿Ğn en los que se puedan derivar del aprendizaje autom¿ótico, cuando la m¿óquina va sola. í░El problema general es c¿«mo evitar los efectos negativos. Es muy complejo predecir consecuencias. Necesitamos una nueva generaci¿«n de robots. No vale que la inteligencia artificial sirva para realizar una tarea. Necesitamos robots emp¿óticos, que entiendan las consecuencias de sus actos y negocien c¿«mo ejecutar la tarea. Esa es la nueva generaci¿«n de robots. Si piensas en c¿«mo trabaja la mente, cuando tomamos una decisi¿«n tambi¿Ğn imaginamos las consecuencias y eso debe ser parte de la inteligencia artificialí▒.

í░Tenemos que ser m¿ós humanosí▒, a?ade Mar¿¬a Amparo Alonso Betanzos, experta en inform¿ótica biom¿Ğdica y representante de la Asociaci¿«n Espa?ola de Inteligencia Artificial (AEPIA). í░No estoy hablando de la supervisi¿«n humana, que est¿ó en las directrices de la Uni¿«n Europea. Debemos tener en cuenta una visi¿«n m¿ós multinivel en la que incluyamos tambi¿Ğn consideraciones psicol¿«gicas y sociol¿«gicas porque nuestras herramientas van a ser utilizadas por las personasí▒.

De esta forma, la inteligencia artificial tiene que ser m¿ós humana en su esencia, en su concepci¿«n. Pero tambi¿Ğn en sus consecuencias, especialmente, cuando la tecnolog¿¬a empieza a ser accesible sin conocimientos inform¿óticos.

Una de las grandes preocupaciones, que ya surgi¿« con la primera Revoluci¿«n Industrial, es el efecto en el trabajo, que ya ha dejado de ser un planteamiento te¿«rico. La visi¿«n optimista es que la herramienta mejorar¿ó las capacidades de los trabajadores, ahorrar¿ó procesos tediosos, rutinarios o penosos e impulsar¿ó la econom¿¬a. La pesimista, que las empresas aumentar¿ón la rentabilidad a costa de destruir empleos susceptibles de mecanizar o aquellos que parec¿¬an a salvo, los que requieren habilidades creativas y razonamiento l¿«gico. Ha sido uno de los ejes de la huelga de guionistas y actores de Hollywood.

Un estudio de OpenAI, Open Research y la Universidad de Pennsylvania calcula que los modelos de IA generativa, como ChatGPT, pueden tener alg¿▓n efecto en el 80% de la fuerza laboral. En este sentido, la secretaria general del sindicato CCOO de Andaluc¿¬a, Nuria L¿«pez Mar¿¬n, advierte en unas jornadas sobre transformaci¿«n digital celebradas en la Universidad de C¿ódiz: í░La digitalizaci¿«n es una revoluci¿«n que nos est¿ó afectando en todos los planos de la vida, desde el social y econ¿«mico hasta el laboral, porque todas las profesiones se ven afectadas. La transformaci¿«n digital tiene que mejorar la vida de las personas y conllevar nuevos derechos laborales, porque hay un aumento de la productividad que supone mayores beneficios para la empresa y que, en consecuencia, debe suponer una mejora para los trabajadores y trabajadorasí▒. L¿«pez Mar¿¬n aboga por la revisi¿«n de aspectos como horarios, salarios, conciliaci¿«n, formaci¿«n e incluso las cotizaciones e impuestos. í░Los robots no tributar¿ón, pero sus due?os y due?as s¿¬í▒, reclama.

Y para evitar un reguero de v¿¬ctimas del nuevo analfabetismo digital, Juan Ram¿«n Astorga, ingeniero, profesor de la Universidad de C¿ódiz y directivo de Tecnalia, aboga por í░educaci¿«n y formaci¿«ní▒, la primera para llevar la IA a todas las etapas escolares y universitarias y la segunda para asegurar la adaptaci¿«n al cambio de todos los trabajadores. Astorga conf¿¬a en la colaboraci¿«n de entidades p¿▓blicas y privadas.

Entre las primeras figuras la Fundaci¿«n Estatal para la Formaci¿«n en el Empleo (Fundae), que cuenta con una plataforma de contenidos en l¿¬nea financiada con fondos NextGeneration. Entre las iniciativas privadas, IBM se ha comprometido a capacitar, con la herramienta SkillsBuild, a dos millones de estudiantes para finales de 2026. í░Es fundamental que las siguientes generaciones conozcan lo que la IA aporta a las empresas y al conjunto de la econom¿¬a, as¿¬ como el cambio de paradigma que supone, con independencia de los estudios que cursení▒, explica Pilar Villacorta, directora de Universidades y Educaci¿«n Superior de IBM para Espa?a, Portugal, Grecia e Israel.

Los robots no tributar¿ón, pero sus due?os y due?as s¿¬Nuria L¿«pez Mar¿¬n, secretaria general CC OO en Andaluc¿¬a

La iniciativa responde a datos como los surgidos en el informe del Institute of Business Value de IBM, que calcula que la implementaci¿«n de la IA y la automatizaci¿«n requerir¿ó que el 39,4% de la mano de obra vuelva a capacitarse en los pr¿«ximos tres a?os. Globalmente, este porcentaje equivaldr¿¬a a 1.400 millones de los 3.400 millones de trabajadores del mundo, seg¿▓n las estad¿¬sticas del Banco Mundial.

En todo este complejo panorama de equilibrio inestable entre un sistema fundamental para el desarrollo y los riesgos, faltan dos herramientas clave: la legislativa y la policial, entendida esta ¿▓ltima como el mecanismo de control y seguimiento que vigile que la primera se cumple. í░Estamos dando pasos. Hemos creado ya la primera Agencia Espa?ola para la Supervisi¿«n de la Inteligencia Artificial [AEISA]í▒, recuerda Mar¿¬a Amparo Alonso Betanzos. Con los estatutos aprobados en agosto, la entidad, con sede en A Coru?a, comenzar¿ó a funcionar a final de a?o con un nuevo marco regulatorio previsto para las pr¿«ximas semanas.

Europa, bajo la presidencia espa?ola, ultima en estas semanas esas reglas del juego en sus pa¿¬ses: la AI Act o Reglamento de Inteligencia Artificial. Esta normativa establecer¿ó las obligaciones para proveedores y usuarios en funci¿«n de cuatro niveles de riesgo de la inteligencia artificial:

í░Inaceptablesí▒. Estas aplicaciones estar¿ón prohibidas y se refieren a sistemas que manipulen, de clasificaci¿«n social o de identificaci¿«n biom¿Ğtrica remotos o en tiempo real.

í░De alto riesgoí▒. Tendr¿ón supervisi¿«n permanente y agrupa a modelos que puedan perjudicar la seguridad o los derechos fundamentales, como aquellas vinculadas al coche aut¿«nomo o al control de fronteras o al ¿ómbito laboral.

í░De inteligencia generativaí▒. Contar¿ón con exigencias de transparencia y se refiere a aplicaciones como ChatGPT o Bard.

í░De riesgos limitadosí▒. Estar¿ón obligadas a informar de forma fehaciente a los usuarios que est¿ón ante una creaci¿«n de inteligencia artificial (im¿ógenes, video o audio conocidos como deepfakes).

í░La Uni¿«n Europea viene trabajando desde hace a?os en lo que ser¿ó un reglamento, que es importante porque ser¿ó de obligado cumplimiento, sin adaptaci¿«n en cada pa¿¬s, como pasa con las directivasí▒, explica Cecilia Danesi, abogada especializada en IA y derechos digitales, profesora la Universidad Pontificia de Salamanca y otras universidades internacionales, divulgadora y autora de El imperio de los algoritmos (Galerna, 2023).

La inteligencia artificial tiene un poder expansivo enorme. Si un humano causa un da?o, es limitado. El de un sistema de inteligencia artificial, en cuesti¿«n de segundos, es infinitoCecilia Danesi, abogada especializada en IA y derechos digitales

Danesi, integrante tambi¿Ğn del grupo Mujeres por la ?tica de la Inteligencia Artificial (Women4Ethical AI) de la Unesco, explica que la propuesta inicial aprobada en junio ha pasado a una fase de negociaci¿«n entre los Estados miembros de la UE. Espa?a, durante la presidencia de este semestre, promueve que las negociaciones í░aseguren que no se socava la innovaci¿«n y que, al mismo tiempo, se protejan los derechos fundamentales de las personasí▒, seg¿▓n un documento de trabajo de la delegaci¿«n espa?ola. La ministra de Justicia en funciones, Pilar Llop, coincide: í░No podemos renunciar a las nuevas tecnolog¿¬as, incluida la inteligencia artificial, porque ser¿¬a renunciar a nuestro propio futuroí▒. Llop advierte sobre los abusos y los sesgos para concluir: í░Debemos evitar que sustituyan una habilidad que es patrimonio de la humanidad: diferenciar el bien del malí▒.

Hasta ahora, lo que se regula son las consecuencias de los actos. En el caso de Almendralejo se aplica la norma sobre pederastia del C¿«digo Penal o el C¿«digo Civil en reclamaciones de indemnizaci¿«n, por ejemplo. í░El reglamento de la UE regular¿ó el desarrollo y el uso de la inteligencia artificial, es decir, no se cambia ni el C¿«digo Penal ni las normas de responsabilidad civil, que se van a aplicar cuando un sistema de inteligencia artificial ocasiona da?os, sino que es una regulaci¿«n general preventiva, porque establece las obligaciones que van a tener que cumplir los sujetos que provean herramientas basadas en inteligencia artificial. La idea, y eso para m¿¬ es muy interesante, es evitar que el da?o se produzcaí▒, detalla Danesi.

La experta en derecho digital a?ade que í░la inteligencia artificial tiene un poder expansivo enorme. Si un humano causa un da?o, es limitado. El de un sistema de inteligencia artificial, en cuesti¿«n de segundos, es infinitoí▒.

Todos los sistemas incluidos en la propuesta de reglamento ya se est¿ón usando, como el reconocimiento facial o de emociones en ¿ómbitos laborales o escolares o los sistemas policiales predictivos o los dirigidos a manipular la voluntad o influir en procesos electorales.

Tambi¿Ğn est¿ón ya funcionando los contenidos creativos generados por la IA. í░Hay un gran debate con lo que son los derechos de autor porque los sistemas de IA generativa se alimentan libremente de todo lo que circula en la redí▒, advierte Danesi.

Felipe G¿«mez-Pallete, presidente de Calidad y Cultura Democr¿óticas, sostiene que í░la tecnolog¿¬a, una vez desarrollada, no hay quien la pareí▒. í░La podemos regular, atemperar, pero llegamos tardeí▒, advierte.

Danesi matiza esa afirmaci¿«n. í░No se puede regular lo que no existe y, cuando existe, la regulaci¿«n llega tardeí▒. Pero a?ade: í░La propuesta de legislaci¿«n de la UE es la m¿ós avanzada del mundo para regular la inteligencia artificial de manera integral y era necesario que corriera agua bajo el puente para poder hacer una ley lo m¿ós coherente y concienzuda posible. En los procesos legislativos, siempre vamos a estar retrasados porque no se puede regular lo que no conocemos y es imposible saber qu¿Ğ aplicaciones, qu¿Ğ usos van a tener estos sistemas en el futuro. Por el tipo de tecnolog¿¬a, siempre vamos a estar un poco haciendo malabares. Por eso no tenemos que regular una tecnolog¿¬a concreta sino ¿óreas, sectores e impactos de la aplicaci¿«ní▒.

Puedes seguir a EL PA?S Tecnolog¿¬a en Facebook y X o apuntarte aqu¿¬ para recibir nuestra newsletter semanal.

Tu suscripci¿«n se est¿ó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripci¿«n?

Si contin¿▓as leyendo en este dispositivo, no se podr¿ó leer en el otro.

FlechaTu suscripci¿«n se est¿ó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripci¿«n a la modalidad Premium, as¿¬ podr¿ós a?adir otro usuario. Cada uno acceder¿ó con su propia cuenta de email, lo que os permitir¿ó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripci¿«n de empresa? Accede aqu¿¬ para contratar m¿ós cuentas.

En el caso de no saber qui¿Ğn est¿ó usando tu cuenta, te recomendamos cambiar tu contrase?a aqu¿¬.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrar¿ó en tu dispositivo y en el de la otra persona que est¿ó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aqu¿¬ los t¿Ğrminos y condiciones de la suscripci¿«n digital.

Sobre la firma