MayĻēsculas, exclamaciones, emojis, dibujos, imĻĒgenes y vĻŠdeos delatan los bulos

Un equipo de Granada y el Imperial College desarrolla un programa para identificar noticias falsas

En torno a una cita casual en un bar salen algunos proyectos interesantes. De una reuniĻŪn de amigos durante unas copas surgiĻŪ la misiĻŪn israelĻŠ a la Luna. Algo parecido ocurriĻŪ con una reciente investigaciĻŪn sobre las caracterĻŠsticas de los bulos o fake news en Twitter, una de las principales redes sociales. A Miguel Molina, cientĻŠfico de datos que investigaba en el Imperial College de Londres, mientras conversaba con Juan GĻŪmez Romero, del departamento de Ciencias de la ComputaciĻŪn de la Universidad de Granada, se le ocurriĻŪ desarrollar un sistema para detectar los bulos. Sus resultados preliminares detectan patrones de escritura, envĻŠo y comportamiento que abren la puerta a acabar con la plaga de la desinformaciĻŪn. No obstante, Twitter advierte de las limitaciones de estudios similares.

Ą°Lo primero fue acotar el campo de investigaciĻŪn y definir fake newsĄą, comenta Molina. Ą°De forma muy resumida, son mentiras intencionadas que buscan dinero o trĻĒficoĄą, explica. Esa definiciĻŪn coincide con otras de este mismo campo que vinculan la proliferaciĻŪn de noticias falsas a intentos de desestabilizaciĻŪn, influencia y monetizaciĻŪn.

Ą°Un familiar o un amigo puede pensar que estĻĒ enviando informaciĻŪn que cree que es verdadera, pero no tiene intenciĻŪn en elloĄą, explica el investigador. Con esta premisa, el equipo, con la colaboraciĻŪn del Imperial College, comenzĻŪ a recopilar, anotar y seleccionar tuits que respondĻŠan a su objeto de estudio.

La aplicaciĻŪn de anĻĒlisis estadĻŠsticos y matemĻĒticos sobre el material arrojĻŪ unas caracterĻŠsticas particulares en la redacciĻŪn de las fake news: suelen incorporar mayĻēsculas, exclamaciones, emojis (pictogramas), dibujos, imĻĒgenes y vĻŠdeos. Ą°Buscan la sorpresa, llamar la atenciĻŪnĄą, argumenta Molina.

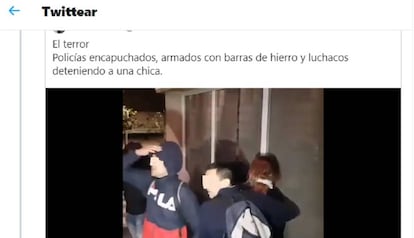

Nights of horror in Catalonia. Young pro-independence female activist kidnapped by police in Tarragona pic.twitter.com/HTJ9sXX3cw

— Josep LluĻŠs Alay ? (@josepalay) October 22, 2019

Tuit difundido el pasado 22 de octubre en el que, encabezado con la expresiĻŪn "Noches de horror en Catalu?a", se atribuye a la policĻŠa el "secuestro" (PrivaciĻŪn de libertad ambulatoria a una persona o grupo de personas, exigiendo, a cambio de su liberaciĻŪn, el cumplimiento de alguna condiciĻŪn, como puede ser el pago de un rescatede) de una "joven". Se trata de la detenciĻŪn de una mujer en Tarragona por los disturbios contra la sentencia del procĻĶs. La magistrada del Juzgado de InstrucciĻŪn 1 de Tarragona, en funciones de guardia, dictĻŪ orden de prisiĻŪn provisional sin fianza para la acusada.

Este comportamiento pretende pescar en aguas de la polarizaciĻŪn, es decir, Ą°funcionan porque los destinatarios estĻĒn dispuesto a creerse las noticias falsasĄą. Con esa complicidad entre emisor y receptor, la capacidad de penetraciĻŪn y difusiĻŪn se multiplica. Su envĻŠo masivo ya consigue el efecto deseado cuando la intenciĻŪn es la influencia. Si, ademĻĒs, se quiere conseguir dinero, incluye enlaces para transferir trĻĒfico a una determinada web con el fin de monetizar las visitas o atraer compras o pagos.

El trabajo, publicado en la revista internacional IEEE Access, analiza matemĻĒticamente otras caracterĻŠsticas de los tuits, como los metadatos que identifican la cuenta, el autor, el nĻēmero de seguidores, favoritos, contactos o fecha de registro en la red social.

Todas estas caracterĻŠsticas, filtradas por un programa informĻĒtico, han permitido determinar que las cuentas que comparten informaciĻŪn errĻŪnea se crean vinculadas a un episodio (disturbios en Catalu?a, elecciones, Brexit) concreto de la actualidad. De esta forma, ademĻĒs de tener mĻĒs opciones de captar la atenciĻŪn al sumarse a temas que son tendencia, se benefician de un menor tiempo de los equipos de la red social y ajenos para que sean verificadas.

TambiĻĶn han detectado que las cuentas de fake news usan caracteres extra?os tanto en su nombre como en su descripciĻŪn, y tienen pocos seguidores, pero sĻŠ siguen a muchos usuarios a los que intentan ganar con su adhesiĻŪn y que sirvan de correa de transmisiĻŪn. Este comportamiento, conocido como reciprocidad altruista, permite que ?la creaciĻŪn de enlaces dirigidos a otros nodos impulse a los segundos a corresponder mediante la creaciĻŪn de un vĻŠnculo con el primero?, segĻēn la investigaciĻŪn.

De esta forma, ya sean creados por robots o por personas, tanto en su creaciĻŪn como en la estrategia de difusiĻŪn buscan explotar sesgos humanos conocidos, como el de confirmaciĻŪn (tendencia a favorecer, buscar y recordar la informaciĻŪn que confirma las propias creencias) o como el mencionado de reciprocidad altruista.

El modelo desarrollado por Molina y GĻŪmez con la colaboraciĻŪn del Imperial College permite establecer una clasificaciĻŪn numĻĶrica sobre las probabilidades de que el tuit analizado sea un bulo. De esta forma, se puede establecer un cĻŪdigo numĻĶrico (50% de ser fake news) o de colores (rojo o verde) para advertir al lector de que podrĻŠa encontrarse ante una mentira intencionada.

Los sistemas actuales de verificaciĻŪn manual no son capaces de responder a todo el trĻĒfico que se genera, circunstancia que aprovechan los propagadores de bulos para inundar las redes. Con un algoritmo matemĻĒtico, al menos se podrĻŠa preavisar a los usuarios de quĻĶ tipo de informaciĻŪn estĻĒn recibiendo y las probabilidades de que se trate de una falsedad, explica Molina.

Twitter advierte de las limitaciones de estos programas

La red social ha agradecido la investigaciĻŪn y reitera que para proyectos similares ponen a disposiciĻŪn del pĻēblico de forma gratuita los datos de su interfaz de programaciĻŪn de aplicaciones (API). "NingĻēn otro servicio o plataforma hace esto", afirman fuentes de la compa?ĻŠa.

Sin embargo, la red social recuerda que su director de Integridad, Yoel Roth, ya ha advertido de los defectos y fallos en la investigaciĻŪn de bots o mensajes creados de forma automĻĒtica. "Vemos una gran cantidad de investigaciones (...) que realizan evaluaciones exhaustivas de los comportamientos de la cuenta utilizando solo se?ales pĻēblicas, como la ubicaciĻŪn (si se cita), el contenido de la cuenta, la frecuencia de tuits y las cuentas que siguen. Para ser claros: ninguno de estos indicadores es suficiente para determinar la atribuciĻŪn definitivamente. Buscar cuentas que se parezcan a las divulgadas es un enfoque igualmente defectuoso, dado que muchos de los malos actores imitan las cuentas legĻŠtimas para parecer creĻŠbles. Este enfoque tambiĻĶn a menudo captura errĻŪneamente las voces legĻŠtimas que comparten un punto de vista polĻŠtico particular con el que uno no estĻĒ de acuerdo".

"Antes de participar en este tipo de investigaciĻŪn y hacer estas afirmaciones, se deben considerar las normas ĻĶticas. Hacer lo contrario no promueve el conocimiento pĻēblico, sino que corre el riesgo de socavar profundamente la confianza en el debate pĻēblico y la conversaciĻŪn", advierte Roth.

Tu suscripciĻŪn se estĻĒ usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciĻŪn?

Si continĻēas leyendo en este dispositivo, no se podrĻĒ leer en el otro.

FlechaTu suscripciĻŪn se estĻĒ usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciĻŪn a la modalidad Premium, asĻŠ podrĻĒs a?adir otro usuario. Cada uno accederĻĒ con su propia cuenta de email, lo que os permitirĻĒ personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripciĻŪn de empresa? Accede aquĻŠ para contratar mĻĒs cuentas.

En el caso de no saber quiĻĶn estĻĒ usando tu cuenta, te recomendamos cambiar tu contrase?a aquĻŠ.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarĻĒ en tu dispositivo y en el de la otra persona que estĻĒ usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquĻŠ los tĻĶrminos y condiciones de la suscripciĻŪn digital.

Sobre la firma