Laurence Devillers: í░Uno es libre de enamorarse de lo que quiera. Pero si es de una mĘóquina, es falsoí▒

La cientʬfica francesa, experta en computaciʫn afectiva, reflexiona sobre la relaciʫn de los seres humanos con los productos de inteligencia artificial

Un hombre japonĘŽs de mediana edad aparece en la imagen durmiendo en su cama. Una voz proveniente de un holograma proyectado en su velador lo despierta con un buenos dʬas. El dibujo, una mujer de pelo celeste. ?l, con solo apretar un botĘ«n, comienza a dialogar. La mĘóquina le advierte que lleve un paraguas y le mete prisa para que no llegue tarde al trabajo. Mientras el hombre almuerza solo en su oficina, se textea con el holograma, que le pide que llegue temprano a casa. En el bus de regreso, le avisa que estarĘó ahʬ en breve. í░No puedo esperar a verteí▒, le responde la mĘóquina de inteligencia artificial, que enciende las luces de la casa para recibir a su due?o. Cuando el hombre cruza el umbral, lo primero que hace es ir a verla. Ven la televisiĘ«n y el hombre le dice lo bien que se siente í░tener a alguien en casaí▒.

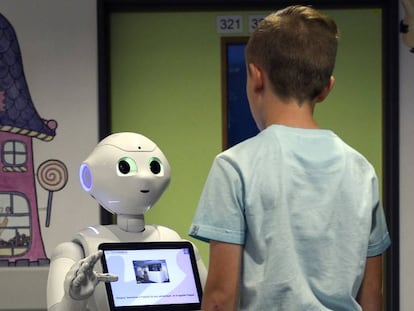

El vʬdeo de la empresa Gatebox es uno de los ejemplos que ense?a este jueves la cientʬfica francesa Laurence Devillers en su presentaciĘ«n en Congreso Futuro, un encuentro entre cientʬficos y humanistas de talla mundial celebrado en Santiago de Chile. Devillers, profesora de Inteligencia Artificial y ?tica en la Universidad de la Sorbona, lleva 20 a?os investigando la computaciĘ«n afectiva. En una entrevista posterior a su presentaciĘ«n en el centro de extensiĘ«n del Instituto Nacional aborda las relaciones mĘóquinas-seres humanos.

Pregunta. El hombre japonĘŽs del vʬdeo dice que se siente bien tener a alguien en casa, pero en realidad no hay nadie ahʬíş

Respuesta. Sʬ, es una ilusiĘ«n total. Muchas personas pueden ser muy vulnerables a este tipo de mĘóquinas, porque la soledad es una pesadilla, especialmente al final de la vida. QuizĘó pueden hacernos compa?ʬa. No es fĘócil una discusiĘ«n sobre este tipo de cosas, pero no creo que simplemente haya que prohibirlas. Si te hacen mĘós feliz, ?por quĘŽ no? Lo que sʬ, hay que tener en cuenta a dĘ«nde van tus datos obtenidos por la mĘóquina, quĘŽ grabaciones recopila, con quĘŽ propĘ«sito accede a tu informaciĘ«níş TambiĘŽn que son una especie de adicciĘ«n. Podemos pasar demasiado tiempo interactuando con este nadie, como dice usted. Aunque no es nadie, es algo que viene de ti porque hablas con una mĘóquina que aprende de tu historia, de tus gustosíş. Este recuerdo de lo que eres tiene una manera maravillosa de manipularte. Ese es el problema.

P. ?CĘ«mo se aborda ese problema?

R. Hay que desarrollar normas para este tipo de mĘóquinas. Hay tres tipos de dimensiones muy importantes: una es la ley, con sus lʬneas rojas. Otra es ayudar a las empresas del rubro a construir un sistema alineado con la ley. Y la tercera es intentar que las directrices ĘŽticas estĘŽn disponibles para todos en la sociedad.

P. ?CuĘón delicado es que la gente que usa estas mĘóquinas confunda la realidad con la realidad virtual?

R. La mayorʬa del tiempo no hay confusiĘ«n. Es el mismo cuerpo. Lo que pasa es que en la realidad virtual puedes hacer lo que quieras, no hay reglasíş En la serie Westworld mucha gente intenta matar, robar, porque no hay pecado, pero no es cierto. Finalmente, lo que hagas en el espacio virtual tambiĘŽn tendrĘó algunas consecuencias en tu vida real. Y debemos tener algunas reglas, al igual que en la vida real.

P. Es posible que pasemos cada vez mĘós tiempo en la realidad virtual, donde no hay consecuencias.

R. Sʬ, es un riesgo. Si pasas toda tu vida en esta realidad virtual, eres solo un cliente en la matrix. Necesitamos educarnos sobre este sistema para usarlo bien. TambiĘŽn estĘó el problema de gĘŽnero, racial, la falta de diversidad cultural. Estas mĘóquinas hacen estadʬsticas. El chat GPT, por ejemplo, es mayoritariamente en inglĘŽs, porque se alimenta de mucha opiniĘ«n del pueblo estadounidense. Cuando preguntas por la fiesta nacional te dice el 4 de julio, que no es tu fiesta. Para evitar este tipo de cosas tenemos que construir nuestro propio sistema de IA, entenderlo mejor y utilizarlo para cosas Ę▓tiles, como la ciencia, la medicina, la ecologʬa. Ahora estamos como un bebĘŽ frente a algo que no entendemos.

P. Sobre el sesgo de gĘŽnero, razaíş ?QuĘŽ se puede hacer?

R. En estas mĘóquinas hay mucha mĘós presencia de mujeres que de hombres. Cuando hablas con un chatbot, su voz es femenina. Cuando buscas un robot sexual u otro tipo de robots, hay muchas mĘós chicas. Una vez le preguntĘŽ a un gran director de un banco en Francia por quĘŽ el chatbot se llamaba Greta y no Gerk. Dijo: HablĘŽ con mis clientes masculinos y prefieren la voz de mujer y mis clientas mujeres respondieron lo mismo. La voz femenina estĘó predeterminada en todas partes. Cuando compras un auto, viene por defecto con voz de mujer. Y si quieres cambiarla, tienes que seguir los pasos, lo que implica un esfuerzo que no todos hacen. ?QuĘŽ es esta representaciĘ«n en la mente de las personas? ?Creen que es algo positivo? La pregunta es por quĘŽ no hay hombres robots para mujeres.

P. ?Nadie los pide?

R. Hay dos cosas. Una es que los que estĘón construyendo los robots son hombres, entonces las hacen para ellos sin pensar en las consecuencias. EstĘó Sofʬa, Alexa, Siriíş La segunda es que efectivamente no tenemos el mismo deseo de dominio. Me gustarʬa que Europa, por ejemplo, aplicara una peque?a regla que diga que cuando compras un objeto capaz de hablar con los demĘós se debe colocar de manera aleatoria la voz de un hombre, una mujer o una tercera opciĘ«n. Si para su producto necesita que haya una voz femenina, debe explicar bien por quĘŽ.

P. En su presentaciʫn se vio a una madre que, a travʎs de unas gafas de realidad virtual, abrazaba a su hija muerta. ?El cerebro es capaz de que algo asʬ no lo enga?e?

R. Sʬ, pero es difʬcil. La representaciĘ«n de personas reales en estas mĘóquinas es una pesadilla porque normalmente piensas que hay una parte de la persona que conoces en el artefacto. Es muy difʬcil mantener la distancia. Ahora hay un mercado para eso y el problema siempre es el mismo: si hay mercado, algunas personas dudan. Lo que podemos hacer es poner el foco en los estĘóndares que deben cumplir, las normas, las pautas.

P. ?QuĘŽ tipo de normas se pueden establecer en este caso en particular?

R. Es un tema que hay que estudiarlo mejor, todavʬa no puedo decir si es bueno o malo. Algunos paʬses como JapĘ«n ya conectan la cara de alguien a un robot y lo usan durante el duelo. El robot utiliza los vʬdeos, imĘógenes y recuerdos grabados de la persona fallecida. Es capaz de elaborar preguntas y respuestas, como simulando una conversaciĘ«n entre el usuario y el fallecido. Hasta ahora, era un sistema que podʬa reproducir las frases que habʬa dicho realmente la persona muerta, pero si uso chat GPT o algo por el estilo, el sistema puede inventar nuevas frases, y ahʬ hay un problema porque pones palabras en la boca de alguien sin su consentimiento. A raʬz de esto, muchas personas empezaron a ir a las residencias de ancianos para recolectar datos, diciendo que finalmente hay una manera de ser inmortal. Ahʬ hay algo que tenemos que reflexionar.

P. Se dice que una de las dificultades para regular la inteligencia artificial es que avanza tan rĘópido que una vez que se aprueba la norma, ya estĘó obsoleta.

R. Es muy rĘópido, pero cuidado, la mistificaciĘ«n de la IA es un gran tema. Simplemente son nĘ▓meros, algunos datos recopilados y mezclados con otros en un modelo que es una caja negra. Luego pueden producir algo parecido a nuestro idioma, que es maravilloso. Pero no hay verificaciĘ«n, no hay fuentes, es incierto. A Google le haces una pregunta ĘCcuyos resultados sabemos que estĘón manipulados porque hay gente que paga por aparecer primero-, pero hay una serie de enlaces ordenados y tĘ▓ valoras cuĘóles son buenos o malos, cuĘóles te sirven para tu investigaciĘ«n, cuĘóles te parecen poco confiables, etcĘŽtera. Tomas decisiones. Ahora es la mĘóquina de IA la que hace eso sin ninguna consciencia ni contexto del contenido. Sin moral. Nada. Solo estadʬsticas. Para los ni?os es una pesadilla porque tienen los resultados sin pasar por el procedimiento de cĘ«mo obtenerlos. Tenemos que impulsar la IA para aprender a cĘ«mo aprender.

P. Usted lleva 20 a?os en la computaciĘ«n afectiva y ahora ya se habla de la posibilidad de que alguien se enamore de una mĘóquina. ?QuĘŽ opina?

R. Mi libertad es poder enamorarme de lo que quiero. Un Ęórbol, una computadora, chatbots informĘóticos ?por quĘŽ no? Es mi libertad. Pero debo entender que si me enamoro de una mĘóquina, es falso. Recuerda la pelʬcula Her, cuando en un punto el chico descubre que la mĘóquina estĘó enamorada de mucha gente. La unicidad del amor no estĘó en la mĘóquina.

P. ?El japonĘŽs solitario de su vʬdeo puede que estĘŽ enamorado del la mĘóquina?

R. No. Creo que uno puede imaginar eso mĘós en los ancianos. Cuando estĘós cerca de la muerte y tu pareja estĘó muerta y tus hijos no estĘón y te sientes realmente solo. Ahʬ quizĘó este tipo de mĘóquinas sean un compa?ero Ę▓til. Mucha gente hace lo mismo con las mascotas. Para mʬ es obvio que si eres bastante estable en tu vida, con gente a tu alrededor, no querrĘós tener este tipo de mĘóquinas. Seguro que si estĘós solo y no tienes mucha gente alrededor, quizĘó podrʬa ayudar. No sĘŽ. Es una pregunta que hay que pensaríş Este es un problema de coevoluciĘ«n de mĘóquinas. La inteligencia artificial no es inteligente, pero sʬ artificial, es un artefacto que hemos construido como un automĘ«vil. Entonces, si prefieres pasar tu tiempo con objetos, ?por quĘŽ no? Para mʬ, debemos ser conscientes colectivamente de los riesgos y construir mĘós comunidad, mĘós intercambios. Entender lo que pasa y ayudar a los demĘós a intentar no perderse en esta transiciĘ«n. Es fundamental estar alertas y detectar la mejor manera de utilizar este tipo de mĘóquinas.

Suscrʬbase aquʬ a la newsletter de EL PA?S Chile y reciba todas las claves informativas de la actualidad del paʬs.

Tu suscripciĘ«n se estĘó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciʫn?

Si continĘ▓as leyendo en este dispositivo, no se podrĘó leer en el otro.

FlechaTu suscripciĘ«n se estĘó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciĘ«n a la modalidad Premium, asʬ podrĘós a?adir otro usuario. Cada uno accederĘó con su propia cuenta de email, lo que os permitirĘó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripciĘ«n de empresa? Accede aquʬ para contratar mĘós cuentas.

En el caso de no saber quiĘŽn estĘó usando tu cuenta, te recomendamos cambiar tu contrase?a aquʬ.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarĘó en tu dispositivo y en el de la otra persona que estĘó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquʬ los tĘŽrminos y condiciones de la suscripciĘ«n digital.

Sobre la firma