Los miedos de los expertos sobre el nuevo sistema de reconocimiento facial de la polic¿¬a espa?ola: vigilancia masiva, p¿Ğrdida de anonimato y borrado de datos

Interior no disipa las dudas sobre los aspectos oscuros de la implantaci¿«n de una herramienta llamada a revolucionar las labores policiales, que suscita dudas en torno a su transparencia, proporcionalidad y mecanismos de gobernanza

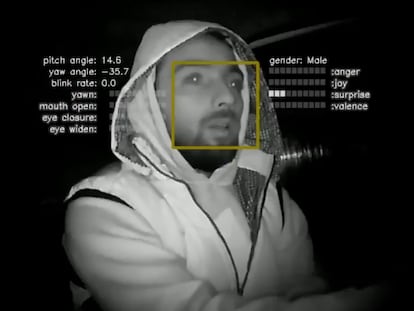

La Polic¿¬a Nacional y la Guardia Civil empezar¿ó este a?o a usar un sistema autom¿ótico de reconocimiento facial en sus investigaciones, tal y como adelant¿« EL PA?S. Se trata de ABIS, una herramienta que emplea algoritmos de inteligencia artificial para determinar en pocos segundos si en una imagen cualquiera figura un rostro del que se tengan registros (en este caso, de personas con ficha policial). La tecnolog¿¬a ya est¿ó lista; solo falta completar la integraci¿«n de la base de datos con la que se empezar¿ó a operar, seg¿▓n fuentes del Ministerio de Interior. En cuanto acabe este proceso, lo que se prev¿Ğ que suceda en la primera mitad de 2023, se podr¿ó empezar a utilizar este programa inform¿ótico, que ha sido desarrollado por la empresa militar francesa Thales.

Pero su aplicaci¿«n presenta varios interrogantes, especialmente relacionados con la transparencia y los mecanismos de control exigibles a herramientas que trabajan con datos biom¿Ğtricos. La propia Agencia Espa?ola de Protecci¿«n de Datos (AEPD) lleva desde septiembre estudiando su encaje en el entramado legislativo, y deber¿ó determinar si vulnera o no alg¿▓n derecho.

Este peri¿«dico ha preguntado a Interior sobre los puntos oscuros o poco claros de ABIS, detectados con la ayuda de varios expertos, entre los que se encuentran dudas sobre su transparencia, la forma de compartir y gestionar las bases de datos o c¿«mo se garantizar¿ó un uso proporcional del sistema. El Ministerio ha rehusado aportar informaci¿«n adicional clave para dispar esas dudas. Estas son las cuestiones que m¿ós preocupan a los ingenieros, analistas y activistas consultados.

1. La sombra de la vigilancia masiva

El uso policial de tecnolog¿¬as autom¿óticas de reconocimiento facial es delicado porque estas permiten identificar inequ¿¬vocamente a los individuos. El sistema es capaz de detectar los rostros humanos en im¿ógenes digitalizadas, ya procedan de un m¿«vil o de c¿ómaras de seguridad, y de extraer un patr¿«n ¿▓nico e inconfundible de los rasgos de cada persona, igual que sucede con las huellas dactilares o el ADN. Aunque hay una diferencia importante: mientras que en los dos ¿▓ltimos casos hace falta establecer contacto f¿¬sico con el afectado (para extraerle las huellas o una muestra de saliva), con el reconocimiento facial se puede hacer todo a distancia.

Eso lo convierte en una tecnolog¿¬a perfecta para la vigilancia masiva. Pek¿¬n lo sabe desde hace a?os. Las calles de las grandes ciudades chinas est¿ón repletas de c¿ómaras dotadas de estos sistemas. Las autoridades pueden localizar en minutos a cualquier ciudadano buscando su rostro en tiempo real. No hay escapatoria posible.

La UE proh¿¬be usar reconocimiento facial en tiempo real en espacios p¿▓blicos. Interior descarta por completo usar ABIS para labores de vigilancia en vez de para investigaciones. Sin embargo, el Ministerio no aclara c¿«mo ni qui¿Ğn va a controlar c¿«mo se usa la herramienta. í░Necesitamos saber cu¿óntas veces se va a utilizar el sistema: ?solo para casos de especial gravedad o para cualquier investigaci¿«n? Si se generaliza su uso, se puede convertir en una herramienta de vigilancia masiva casi sin quererí▒, opina Carmela Troncoso, profesora de la Escuela Polit¿Ğcnica Federal de Lausana (Suiza) y autora del protocolo de rastreo seguro usado en las aplicaciones de rastreo de contagios de la covid.

2. Anonimato y control algor¿¬tmico

La experta tiene dudas tambi¿Ğn sobre el anonimato que promete Thales respecto a la gesti¿«n de los datos biom¿Ğtricos de ABIS. í░La informaci¿«n almacenada se fundamenta en datos alfanum¿Ğricos que imposibilitan la identificaci¿«n del propietario de sus huellasí▒, explica la compa?¿¬a francesa. El objetivo es que si alguien roba esa base de datos no pueda asociar los rostros ah¿¬ guardados con las identidades de los mismos.

í░Esto es un poco dudoso. No porque las representaciones sean alfanum¿Ğricas significa que no se puedan reconstruir, porque hay evidencia de lo contrario: se pueden reconstruir im¿ógenes a partir de los modelos. La pregunta es qu¿Ğ estudios se han hecho para fundamentar estas declaracionesí▒, abunda Troncoso.

Respecto al funcionamiento del algoritmo desarrollado por Thales, tanto la empresa como Interior aseguran que í░ha pasado el Test de Vendedores de NISTí▒, una compa?¿¬a independiente de ¿ómbito no comercial. í░Eso es como no decir nadaí▒, replica Troncoso. í░Tienen un baremo, pero no dicen si eso es bueno, malo o regular. ?Cu¿ól es la puntuaci¿«n del algoritmo en ese test? ?Es la adecuada para el caso de uso propuesto? ?Qui¿Ğn se va a ocupar de comprobar que lo siga siendo con el paso del tiempo?í▒. Preguntado por este diario, Interior no ha respondido a estas cuestiones.

3. Entrar y salir de la base de datos

La otra gran preocupaci¿«n que rodea el uso de esta tecnolog¿¬a es a qui¿Ğn se le aplicar¿ó. Seg¿▓n cont¿« Interior a EL PA?S, la base de datos contra la que se contrastar¿ón las im¿ógenes que se quieran examinar tiene unos cinco millones de rese?as fotogr¿óficas faciales de detenidos y sospechosos que ya estaban fichados por la Polic¿¬a Nacional, la Guardia Civil y otros cuerpos auton¿«micos.

?Durante cu¿ónto tiempo queda registrado un sospechoso en la base de datos? ?Qu¿Ğ sucede cuando un sospechoso deja de serlo, por ejemplo, por ser declarado inocente en un tribunal? ?Se le elimina de la base de datos o permanece en ella? El Ministerio ha preferido no responder tampoco a estas preguntas. í░Limpiar estas bases de datos va a ser un problema. Hace falta tenerlas actualizadas mediante intercambio con las bases de datos de otras instituciones envueltas en el procesoí▒, explica Lorena Jaume-Palas¿¬, experta en ¿Ğtica y filosof¿¬a del Derecho aplicadas a la tecnolog¿¬a y asesora del Gobierno de Espa?a y del Parlamento Europeo para cuestiones relacionadas con la inteligencia artificial. Dicho de otro modo: el Ministerio de Interior deber¿¬a estar coordinado con el de Justicia e intercambiar informaci¿«n, algo que no es la norma ni en este ni en otros pa¿¬ses de nuestro entorno. í░Aqu¿¬ hay al menos dos problemas: por un lado, no tienes la infraestructura necesaria para poder desplegar el sistema a nivel nacional e internacional, y por otro, tienes un problema de enforcement entre instituciones que no cooperaní▒, a?ade la investigadora.

Permanecer en esa base de datos significa poder ser identificado como sospechoso en cualquier crimen. Porque los algoritmos fallan, y los agentes que examinan los candidatos que aporta ABIS en una b¿▓squeda pueden equivocarse tambi¿Ğn.

4. Con qui¿Ğn se comparten los datos

Interior tiene intenci¿«n de compartir los datos biom¿Ğtricos faciales que almacena con sus socios europeos. í░El sistema ABIS de Espa?a puede conectarse con bases de datos comunitarias, como Eurodac, EU-Lisa o VISí▒, explican fuentes de Thales. Seg¿▓n asegur¿« el Ministerio a este peri¿«dico, las bases de datos que maneje la polic¿¬a estar¿ón totalmente separadas de las civiles (por ejemplo, las que contienen las fotos del DNI). í░Pero si el sistema ABIS se integra en EU-Lisa, lo har¿ó con los solicitantes de asilo, que no han delinquido ni son criminalesí▒, se?ala Javier S¿ónchez Monedero, investigador Beatriz Galindo en Inteligencia Artificial del departamento de Inform¿ótica y An¿ólisis Num¿Ğrico de la Universidad de C¿«rdoba.

La reciente reforma de Eurodac, la base de datos europea de huellas dactilares para identificar a los solicitantes de asilo y a los irregulares que cruzan la frontera, elimina la necesidad de tener orden judicial para que la polic¿¬a pueda hacer una consulta. Si se guardan los registros faciales recogidos por las fuerzas de seguridad en esa misma base de datos, se podr¿ó mirar autom¿óticamente sin pasar por el juez. í░Es importante entender cu¿óles son los l¿¬mites y casu¿¬sticas del manejo de datos. Nuestra experiencia previa es que, una vez echan a andar estos sistemas, no paran de crecerí▒, a?ade.

5. ?Por qu¿Ğ recoger datos biom¿Ğtricos?

La pregunta que se hacen muchos expertos es por qu¿Ğ necesitamos esta herramienta. ?Se ha estudiado que los beneficios potenciales de la implantaci¿«n de este sistema superar¿ón a los posibles problemas que genere? Interior asegura que ABIS facilitar¿ó mucho el trabajo de la polic¿¬a. Ser¿ó capaz de identificar r¿ópidamente a sospechosos en im¿ógenes de la escena del crimen que, de otro modo, quiz¿ós no se podr¿¬an localizar.

Pero implantar un sistema autom¿ótico de reconocimiento facial es m¿ós que eso. í░No vas a hacer el proceso m¿ós eficiente, sino que vas a cambiar el proceso en s¿¬í▒, resume Jaume-Palas¿¬. í░Har¿ón falta buenos servidores, copias de seguridad, un mont¿«n de energ¿¬a y reentrenar a los profesionales que trabajan con estos sistemas en la polic¿¬a, entre otros. Son sistemas, adem¿ós, que no pueden funcionar bien porque la idea de fondo, la metodolog¿¬a en s¿¬, es mala. Identificar a personas en base a cualquier categor¿¬a biom¿Ğtrica siempre implica fallos, es necesario utilizar otros m¿Ğtodos y evaluar otros aspectosí▒.

í░No hay un conjunto de algoritmos capaz de abarcar la multidimensionalidad necesar¿¬a para incluir todos los par¿ómetros necesarios para identificar a alguiení▒, prosigue la experta en ¿Ğtica digital. í░El proceso de identificaci¿«n de una persona a partir de sus datos biom¿Ğtricos es un proceso ya de por s¿¬ problem¿ótico, basado en ideas eug¿Ğnicas. El color de la piel, por ejemplo, es un continuo, no puedes dar un n¿▓mero concreto de categor¿¬as. Eso, a nivel t¿Ğcnico, es un problema, porque los sistemas necesitan acotar las variables. Y esta regla se aplica a gran cantidad de rasgos faciales, como la apertura de ojos y boca, tama?o y forma de la nariz, etc¿Ğteraí▒, explica.

Cuanta m¿ós informaci¿«n delicada se acumule, mayor probabilidad de que se haga un mal uso de ella. í░Creemos que realmente no hace falta recoger datos biom¿Ğtricos, ya que atenta contra derechos fundamentales y supone una violaci¿«n de la privacidadí▒, sostiene Youssef M. Ouled, coordinador de AlgoRace, un colectivo que investiga las consecuencias del uso racista de la inteligencia artificial. í░Hay un enorme vac¿¬o de datos sobre estos sistemas, que no se auditan. Apuestan por la securitizaci¿«n, van en direcci¿«n contraria a lo que la sociedad civil est¿ó demandando. Y tienen que ver con la obsesi¿«n del Estado de tener muchos datos sobre nosotros sin que sepamos muy bien qu¿Ğ van a hacer con ellosí▒, abunda.

í░Esta tecnolog¿¬a tiene un potencial enorme para ser algo peligroso, y no sabemos cu¿ól es su potencial real para ser beneficiosoí▒, zanja Troncoso. í░No tenemos ninguna garant¿¬a de que no vaya a tener malas consecuencias. Se nos justifica su uso en aras de la eficiencia, pero ?qu¿Ğ o cu¿ónto vamos a ganar? ?Tenemos alg¿▓n tipo de evidencia al respecto? Estamos hablando de implantar una tecnolog¿¬a que aplica a todos los espa?oles, de la que no puedes decidir no participar y con la que tampoco sabemos si ganamos o perdemosí▒.

Puedes seguir a EL PA?S TECNOLOG?A en Facebook y Twitter o apuntarte aqu¿¬ para recibir nuestra newsletter semanal.

Tu suscripci¿«n se est¿ó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripci¿«n?

Si contin¿▓as leyendo en este dispositivo, no se podr¿ó leer en el otro.

FlechaTu suscripci¿«n se est¿ó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripci¿«n a la modalidad Premium, as¿¬ podr¿ós a?adir otro usuario. Cada uno acceder¿ó con su propia cuenta de email, lo que os permitir¿ó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripci¿«n de empresa? Accede aqu¿¬ para contratar m¿ós cuentas.

En el caso de no saber qui¿Ğn est¿ó usando tu cuenta, te recomendamos cambiar tu contrase?a aqu¿¬.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrar¿ó en tu dispositivo y en el de la otra persona que est¿ó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aqu¿¬ los t¿Ğrminos y condiciones de la suscripci¿«n digital.

Sobre la firma