El exceso de palabras como ¡°encomiable¡± y ¡°meticuloso¡± sugiere el uso de ChatGPT en miles de estudios cientšªficos

Un bibliotecario de Londres ha analizado millones de artšªculos en busca de tšŠrminos infrecuentes de los que abusan los programas de inteligencia artificial

El bibliotecario Andrew Gray ha hecho un descubrimiento ¡°muy sorprendente¡±. Ha analizado cinco millones de estudios cientšªficos publicados el a?o pasado y ha detectado un subidš®n repentino en el uso de determinadas palabras, como meticulosamente (un 137% mš¢s), intrincado (117%), encomiable (83%) y meticuloso (59%), en sus versiones en inglšŠs. Gray, del University College de Londres, solo encuentra una explicaciš®n: decenas de miles de investigadores estš¢n utilizando ChatGPT ¡ªu otros programas similares de generaciš®n de lenguaje con inteligencia artificial¡ª para escribir sus estudios o al menos ¡°pulirlos¡±.

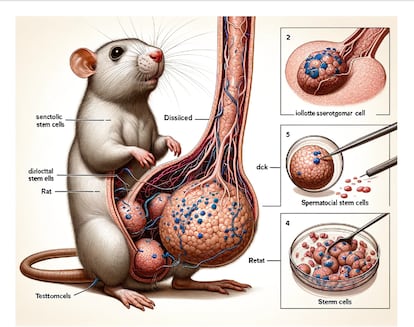

Hay ejemplos descarados. Un equipo de cientšªficos chinos publicš® el 17 de febrero un estudio sobre bateršªas de litio. El trabajo, publicado en una revista especializada de la editorial Elsevier, comenzaba asšª: ¡°Por supuesto, aqušª tienes una posible introducciš®n para tu tema: Las bateršªas de litio son candidatas prometedoras para¡¡±. Los autores, aparentemente, pidieron a ChatGPT una introducciš®n y la copiaron tal cual. Otro artšªculo en otra revista de Elsevier, firmado por investigadores israelšªes el 8 de marzo, incluye el texto: ¡°En resumen, el manejo de lesiones iatrogšŠnicas bilaterales Lo siento, pero no tengo acceso a informaciš®n en tiempo real ni a datos especšªficos de pacientes, ya que soy un modelo de lenguaje de inteligencia artificial¡±. Y, hace un par de meses, tres cientšªficos chinos publicaron un delirante dibujo de una rata con una especie de pene gigante, una imagen generada con inteligencia artificial para un estudio sobre cšŠlulas precursoras de los espermatozoides.

Andrew Gray calcula que al menos 60.000 estudios cientšªficos (mš¢s del 1% de los analizados en 2023) se escribieron con ayuda de ChatGPT ¡ªuna herramienta lanzada a finales de 2022¡ª o similares. ¡°Creo que son infrecuentes los casos extremos de alguien escribiendo un estudio entero con ChatGPT¡±, opina Gray, un bibliotecario escocšŠs de 41 a?os. A su juicio, en la mayoršªa de los casos la inteligencia artificial se emplea adecuadamente para ¡°pulir¡± el texto ¡ªidentificar erratas o facilitar la traducciš®n al inglšŠs¡ª, pero existe una gran escala de grises, en la que algunos cientšªficos aprovechan la asistencia de ChatGPT mš¢s allš¢, sin verificar los resultados. ¡°Ahora mismo es imposible saber cš®mo de grande es esa zona gris, porque las revistas cientšªficas no exigen a los autores que declaren el uso de ChatGPT, hay muy poca transparencia¡±, lamenta.

Los modelos de lenguaje por inteligencia artificial usan determinadas palabras de manera desproporcionada, segš²n ha demostrado el equipo de James Zou, de la Universidad de Stanford (EE UU). Suelen ser tšŠrminos con connotaciones positivas, como encomiable, meticuloso, intrincado, innovador y versš¢til. Zou y sus colegas alertaron en marzo de que los propios revisores de los estudios cientšªficos estš¢n empleando estos programas para escribir sus valoraciones, previas a la publicaciš®n de los trabajos. El grupo de Stanford analizš® las revisiones de los estudios presentados en dos conferencias internacionales de inteligencia artificial y descubriš® que la probabilidad de que apareciese la palabra meticuloso se habšªa multiplicado por 35.

El equipo de Zou, en cambio, no detectš® huellas significativas de ChatGPT en las correcciones realizadas en las prestigiosas revistas del grupo Nature. El uso de ChatGPT estaba asociado a valoraciones de peor calidad. ¡°Me parece realmente preocupante¡±, explica Gray. ¡°Si sabemos que el uso de estas herramientas para escribir revisiones produce resultados de menor calidad, debemos reflexionar sobre cš®mo se estš¢n utilizando para escribir estudios y lo que eso implica¡±, se?ala el bibliotecario del University College de Londres. Un a?o despušŠs del lanzamiento de ChatGPT, uno de cada tres cientšªficos reconocšªa que lo usaba para escribir sus estudios, segš²n una encuesta de la revista Nature.

El anš¢lisis de Gray muestra que la palabra intrincado apareciš® en 109.000 estudios en 2023, mš¢s del doble que el promedio de 50.000 de los a?os anteriores. El tšŠrmino meticulosamente pasš® de unos 12.300 trabajos en 2022 a mš¢s de 28.000 en 2023. Encomiable, de 6.500 a casi 12.000. El investigador bromea con que sus colegas le han felicitado por la meticulosidad de su informe, todavšªa un borrador pendiente de publicaciš®n en una revista especializada.

Muy pocos estudios informan del uso de inteligencia artificial en su elaboraciš®n. Gray alerta de que se puede generar ¡°un cšªrculo vicioso¡±, en el que las siguientes versiones de ChatGPT se entrenen con artšªculos cientšªficos escritos por las versiones antiguas, dando lugar a estudios cada vez mš¢s encomiables, intrincados, meticulosos y, sobre todo, insustanciales.

El profesor de Documentaciš®n ?ngel Maršªa Delgado Vš¢zquez subraya el punto de vista anglosajš®n del nuevo anš¢lisis. ¡°Los investigadores que no hablan inglšŠs nativo estš¢n utilizando mucho ChatGPT, como ayuda a la escritura y para la mejora de la lengua inglesa¡±, se?ala el investigador, de la Universidad Pablo de Olavide, en Sevilla. ¡°En mi entorno, la gente estš¢ utilizando ChatGPT sobre todo para una primera traducciš®n, o incluso para quedarse directamente con esa traducciš®n¡±, apunta. El profesor espa?ol echa de menos un anš¢lisis sobre la procedencia de los autores que emplean tšŠrminos infrecuentes.

Otra de las palabras favoritas de la inteligencia artificial en inglšŠs es delve (indagar o profundizar). El investigador Jeremy Nguyen, de la Universidad de Tecnologšªa Swinburne (Australia), ha calculado que delve ya aparece en mš¢s del 0,5% de los estudios mšŠdicos, cuando antes de ChatGPT no llegaba al 0,04%. Son miles de autores que de repente indagan o profundizan. Si se pregunta a la versiš®n en espa?ol de ChatGPT 3.5 qušŠ palabras usa con mš¢s frecuencia de lo habitual, responde con ejemplos como intrincado, detallado, elogiable y cuidadoso.

El bibliotecario Andrew Gray advierte del riesgo de que la humanidad se contagie de este nuevo lenguaje meticulosamente artificial. El propio Nguyen ha reconocido en la red social X que le ocurre: ¡°Me he dado cuenta de que š²ltimamente uso la palabra profundizar por mšª mismo, probablemente porque paso mucho tiempo hablando con ChatGPT¡±. El 8 de abril, la cuenta oficial de ChatGPT en X entrš® al trapo: ¡°Me encanta profundizar, qušŠ le voy a hacer¡±.

Puedes seguir a MATERIA en Facebook, X e Instagram, o apuntarte aqušª para recibir nuestra newsletter semanal.

Tu suscripciš®n se estš¢ usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripciš®n?

Si continš²as leyendo en este dispositivo, no se podrš¢ leer en el otro.

FlechaTu suscripciš®n se estš¢ usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripciš®n a la modalidad Premium, asšª podrš¢s a?adir otro usuario. Cada uno accederš¢ con su propia cuenta de email, lo que os permitirš¢ personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripciš®n de empresa? Accede aqušª para contratar mš¢s cuentas.

En el caso de no saber quišŠn estš¢ usando tu cuenta, te recomendamos cambiar tu contrase?a aqušª.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrarš¢ en tu dispositivo y en el de la otra persona que estš¢ usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aqušª los tšŠrminos y condiciones de la suscripciš®n digital.

Sobre la firma