Privacidad y datos en un mundo de algoritmos: riesgos y l¿¬mites

La avalancha de informaci¿«n digital ha permitido mejoras sustanciales en la vida de muchos ciudadanos, pero no hay que descuidar las amenazas a la privacidad y los derechos humanos

Un esc¿óner facial en el aeropuerto no reconoci¿« la diferencia entre Osama bin Laden y Winona Ryder. Huellas digitales alteradas ayudan a una mujer a burlar los controles fronterizos. Una empresa es multada por compartir datos de millones de usuarios sin consentimiento. Un algoritmo discrimina contrataci¿«n de mujeres.?Seguramente estos titulares recuerden a alguna noticia similar le¿¬da antes.

Por un lado, sabemos que los datos son la d¿¬namo de la econom¿¬a digital. Compartirlos entre diferentes proveedores í¬p¿▓blicos y privadosí¬ de forma interoperable promete revolucionar servicios que est¿Ğn hechos a la medida de las necesidades de cada persona y minimizar el margen de error de forma costo-eficiente. En servicios sociales, por ejemplo, ha permitido hacer m¿ós eficiente la asignaci¿«n de prestaciones a los beneficiarios que verdaderamente lo necesitan, as¿¬ como que la persona tenga mejor control sobre el cuidado de su salud o su ahorro para el retiro.

Sin embargo, es frecuente que las personas no tengan idea alguna de c¿«mo su perfil, geolocalizaci¿«n, rostro o historial de visitas en l¿¬nea terminan en manos de proveedores que í░conocen sus interesesí▒. Y es que, aunque aceptar los t¿Ğrminos de privacidad y de compartir datos sea una precondici¿«n normalizada para descargar una aplicaci¿«n o visitar un sitio, estos suelen explicarse en un lenguaje complejo de entender entre audiencias no t¿Ğcnicas.

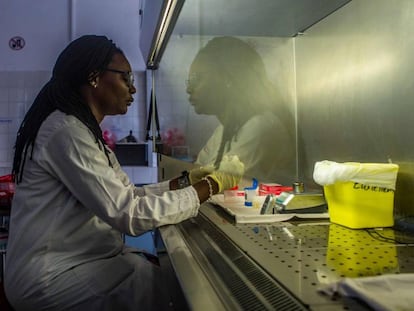

En el campo de la biometr¿¬a, poder identificar a una persona sin su autorizaci¿«n, a trav¿Ğs de su tono de voz, la forma en la que escribe o incluso su forma de caminar, supone riesgos considerables sobre derechos fundamentales como la privacidad y potencial discriminaci¿«n algor¿¬tmica. í░Cuando tu cuerpo es tu identidad, este puede tambi¿Ğn delatarte o revelar cosas que preferir¿¬as no compartirí▒, se?ala la eticista Gemma Galdon Clavel.

Adicionalmente, hay un riesgo de seguridad, si los datos sensibles son vulnerados sin candados de encriptaci¿«n. As¿¬ lo muestra un reciente caso que expuso los datos de huellas digitales, reconocimiento facial, nombres de usuarios y contrase?as de m¿ós de un mill¿«n de personas, dentro de una base de datos p¿▓blica en Reino Unido. De acuerdo con el medio de comunicaci¿«n, la exposici¿«n responde a la falta de protecci¿«n y encriptaci¿«n de la base de datos por la empresa que la resguardaba.

Por eso, el Banco Interamericano de Desarrollo (BID) dedic¿« una nueva serie de publicaciones para analizar el avance del marco regulatorio en ¿Ğtica de datos, advertir cu¿óles son los riesgos de usar tecnolog¿¬as como la inteligencia artificial (IA) con base en datos personales y proponer medidas para mitigarlos. Su edici¿«n m¿ós reciente permite entender a trav¿Ğs de un c¿«mic, cu¿óles son los l¿¬mites de la biometr¿¬a y acciones de contrapeso.

Cuando tu cuerpo es tu identidad, este puede tambi¿Ğn delatarte o revelar cosas que preferir¿¬as no compartir

Para Galdon Clavell, la aplicaci¿«n de tecnolog¿¬as en datos biom¿Ğtricos es una opci¿«n que debe usarse con cautela. Una alternativa, sugiere, es mejorar la interoperabilidad y calidad de los datos usados, para poder verificar informaci¿«n entre instituciones sin tener que acceder a datos personales. Alternativamente, recomienda utilizar la verificaci¿«n de identidad con cadenas de bloques (blockchain) o bien combinar identificadores externos, a trav¿Ğs de contrase?as.

Este tipo de pasos tambi¿Ğn ayuda a generar mayor confianza ciudadana en la era digital, y esto aplica tanto a servicios p¿▓blicos como privados. De acuerdo con Bloomberg, el 83% de los ejecutivos est¿ón de acuerdo que la confianza es la piedra angular de la econom¿¬a digital. A medida que los usuarios y prestadores de servicios toman consciencia de los riesgos y soluciones para un uso responsable de datos, aumentan los incentivos para crear principios y cumplir reglas.

En Am¿Ğrica Latina y el Caribe, algunas organizaciones y pa¿¬ses, como M¿Ğxico, ya cuentan con lineamientos sobre la privacidad y el uso de inteligencia artificial. Pero podemos y debemos hacer mucho m¿ós.

Respecto al marco regulatorio, la referencia global es el Reglamento de Protecci¿«n de Datos de la Uni¿«n Europea (GDPR, por sus siglas en ingl¿Ğs). Esta norma establece que antes de procesar cualquier dato personal, un negocio debe preguntar expl¿¬citamente el permiso de la persona, en un lenguaje claro y con el consentimiento para un prop¿«sito espec¿¬fico. Esta premisa ha abierto, en cierto sentido, una caja de Pandora tanto para reguladores como para empresas, que ¿▓ltimamente contribuir¿ó a un sistema de manejo de datos fortalecido y con epicentro en la persona.

En tan solo un a?o de implementaci¿«n del GDPR, se han registrado 90.000 notificaciones de violaciones de datos y 145.000 quejas. Adem¿ós, 100 organizaciones han pagado sanciones por incumplimiento y Francia mult¿« a Google con 50 millones de euros, por recolectar datos sin el adecuado nivel de trasparencia sobre c¿«mo se usar¿¬an esos datos.

Con el objetivo de acelerar la adopci¿«n responsable de la IA con impacto social, por parte de los gobiernos de Am¿Ğrica Latina y el Caribe, el Sector Social del BID est¿ó preparando una iniciativa regional, conocida como fAIr LAC. Tambi¿Ğn elabor¿« un marco conceptual y metodol¿«gico para apoyar a los pa¿¬ses a facilitar la interoperabilidad de datos en sus plataformas p¿▓blicas de forma ¿Ğtica, que les permita ser m¿ós efectivos en la toma de decisiones y elevar la calidad de los servicios sociales prestados.

Compartir datos se ha convertido en una pr¿óctica esencial de la econom¿¬a digital. Las personas dejamos un halo cr¿«nico de datos digitales, aun sin darnos cuenta. Pero hay riesgos que requieren la atenci¿«n de tomadores de decisi¿«n en cualquier organizaci¿«n que est¿Ğ involucrada con manejo y an¿ólisis de datos compartidos, sobre todo al tratarse de datos privados o de identificaci¿«n biom¿Ğtrica. Mientras que el futuro apunta a un uso de informaci¿«n m¿ós regulado, deja la tarea de generar una cultura de responsabilidad que sea inherente a su gesti¿«n.

Puedes seguir a PLANETA FUTURO en Twitter y Facebook e Instagram, y suscribirte aqu¿¬ a nuestra newsletter.

Tu suscripci¿«n se est¿ó usando en otro dispositivo

?Quieres a?adir otro usuario a tu suscripci¿«n?

Si contin¿▓as leyendo en este dispositivo, no se podr¿ó leer en el otro.

FlechaTu suscripci¿«n se est¿ó usando en otro dispositivo y solo puedes acceder a EL PA?S desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripci¿«n a la modalidad Premium, as¿¬ podr¿ós a?adir otro usuario. Cada uno acceder¿ó con su propia cuenta de email, lo que os permitir¿ó personalizar vuestra experiencia en EL PA?S.

?Tienes una suscripci¿«n de empresa? Accede aqu¿¬ para contratar m¿ós cuentas.

En el caso de no saber qui¿Ğn est¿ó usando tu cuenta, te recomendamos cambiar tu contrase?a aqu¿¬.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrar¿ó en tu dispositivo y en el de la otra persona que est¿ó usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aqu¿¬ los t¿Ğrminos y condiciones de la suscripci¿«n digital.